au sommaire

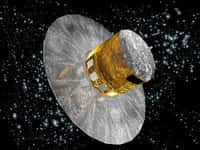

Gaia est un satellite d’astrométrie de l'Agence spatiale européenneAgence spatiale européenne (ESA) lancé en novembre 2013. Construit par Airbus Defence and Space, GaiaGaia, qui fonctionne toujours, a pour but de cartographier en trois dimensions les étoiles de notre Galaxie avec une précision jusqu'alors inégalée, afin de mieux comprendre les mécanismes de formation des galaxies.

Cette mission devrait ainsi permettre de « découvrir et d'inventorier des milliards d'étoiles et des dizaines de milliers d'objets du Système solaire inconnus à ce jour », nous expliquait, en août 2013, François Mignard, directeur de recherche au CNRS et premier responsable du consortium de traitement des données.

Les données de cette mission d’astrométrie inédite pour l'ESA surpassent celles d'HipparcosHipparcos, le satellite d'astrométrie ayant précédé Gaia. Hipparcos a fonctionné pendant quatre ans, de novembre 1989 à mars 1993, et a observé 118.000 étoiles avec une précision astrométrique meilleure qu'une milliseconde d'arc (mas) ainsi qu'une photométrie également très précise (de l'ordre de la milli-magnitude).

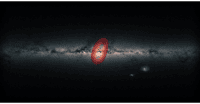

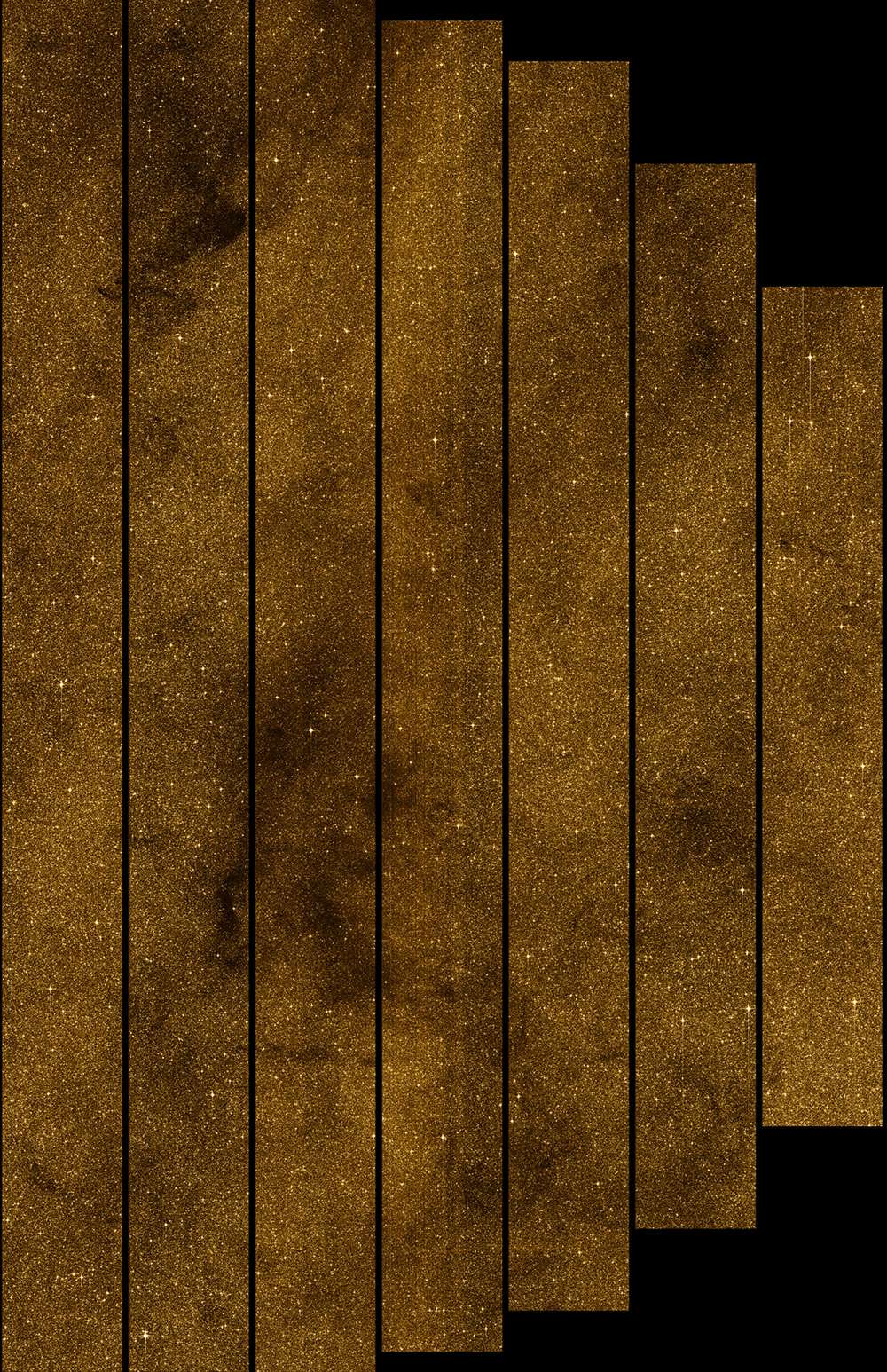

Les étoiles du centre de la Voie lactée observées par le satellite Gaia. © ESA, Gaia, DPAC

Le catalogue Gaia compilera plus de deux pétaoctets de données

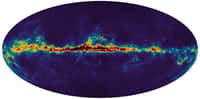

Gaia c'est donc un milliard d'objets observés, dont la totalité des étoiles de notre Galaxie jusqu'à la magnitude 20, voire 21. Le satellite observe tous les objets plus brillants que la magnitude 20 (400.000 fois plus faibles que les plus faibles des étoiles observables à l'œilœil nu), soit environ un milliard d'objets, et ce 80 fois chacun !

Dit autrement, Gaia produit « 10.000 fois plus de données que les missions précédentes et réalise une moyenne de 70 milliards d'observations par jour », nous explique Mathias Robichon, directeur technique chez NetApp France, société qui stocke, pour cette mission, une masse inédite d'informations. Une fois terminé, le catalogue Gaia, publié d'ici 2020, « compilera plus de deux pétaoctets de données ».

Le saviez-vous ?

Les données de Gaia, c'est :

- environ 700 milliards de mesures astrométriques ;

- 150 milliards de mesures spectrophotométriques ;

- 15 milliards de mesures spectroscopiques ;

- 520 gigaoctets qui seront transférés au sol chaque jour ;

- quelque 100 téraoctets (1014 octets) pour les cinq années de mission initiale ;

- 1.000 fois plus que les données brutes du satellite Hipparcos.

Pour gérer et stocker cette quantité de données phénoménale, l'Agence spatiale européenne utilise les services d'hébergement de NetApp, qui met à sa disposition « 176 disques SATASATA de 1 To à 7.200 tours par minute ». Cette société est aujourd'hui leader sur les solutions basées sur des technologies FlashFlash, tirant souvent parti de l'interface NVMe, ce qui permet d'accéder très rapidement aux données sur les baies de stockage.

Comment NetApp voit-elle l'avenir du stockage et de la gestion des données ?

Mathias Robichon : NetApp se positionne comme une société référence en matièrematière de gestion de données. IDC nous place d'ailleurs premier sur les systèmes de stockage à base de technologie Flash, les plus rapides du marché. NetApp développe ses technologies en s'appuyant sur la vision de ce que nous appelons « Data Fabric ».

Data Fabric est une approche logicielle de déplacement et de gestion des données qui offre un ensemble cohérent de capacités et de services incluant un choix de terminaux et d'écosystèmesécosystèmes applicatifs connectés dans le cloud et sur site. Elle propose des services de données intégrés et cohérents pour le cloud hybridehybride, pour la visibilité, l'exploitation, l'accès, le contrôle ainsi que la protection et la sécurité. L'environnement NetApp Data Fabric vise donc à exploiter tout le potentiel des données et à répondre aux défis du futur.

Quelles sont les solutions envisagées pour répondre à l'explosion des données spatiales, notamment celles liées à l'observation de la Terreobservation de la Terre ?

Mathias Robichon : Depuis la création de NetApp et de son système d'exploitationsystème d'exploitation ONTAP, nous travaillons sur des mécanismes de réduction, de compression et de déduplication de la donnée. Les technologies Flash offrent un bond technologique à ce niveau, avec des ratios de réduction pouvant en moyenne aller jusqu'à 5 sur 1. En outre, l'approche Data Fabric répond à ce défi. Le traitement exponentiel des données implique d'innover sur l'ensemble du cycle de vie de la donnée, que ce soit au niveau matériel ou logiciellogiciel. La démocratisation du stockage Flash NVMe, les solutions de gestion de données non structurées, l'interconnexion entre tous les systèmes de stockage dans un cloud dit « hybride » (que les données soient stockées dans un data centerdata center privé ou dans un cloud public chez un fournisseur de type AmazonAmazon Web Services ou un fournisseur local) doivent être à la base de toute réflexion d'organisations faisant face aujourd'hui à une explosion de données.

L'intelligence artificielleintelligence artificielle est-elle utilisée pour gérer ces données ?

Mathias Robichon : En tant que référence en matière de données, NetApp comprend la valeur de l'accès, de l'organisation, de la gestion et du contrôle des données. Nous avons adapté les principes de l'intelligence computationnelle à nos solutions telles que NetApp OnCommand InsightInsight, une plateforme ouverte, pour la gestion de data centers sur site et hybride, et Active IQ, une applicationapplication d'analyse prédictive et de support proactif pour le cloud hybride. Ces solutions sont aujourd'hui déployées dans de nombreuses entreprises et organisations à travers le monde.

La rétine de Gaia avec son milliard de pixels a pris forme

Article de Laurent SaccoLaurent Sacco publié le 24 juillet 2011

Peut-on retracer l'histoire des collisions et fusionsfusions de galaxies, subies par notre Voie lactéeVoie lactée ? Cela devrait être possible grâce à la mission Gaia qui mesurera avec précision les positions et vitessesvitesses d'un milliard d'étoiles à l'horizon 2013-2014. Sa caméra dotée de 106 CCDCCD prend forme actuellement

Faire de l'archéologie galactique, préciser la structure et la dynamique de la Galaxie, telle est l'ambition principale des ingénieurs et astronomesastronomes participant à la mission Gaia qui devrait être lancée en 2013. Une fois une compréhension plus fine de notre Voie lactée acquise, le savoir obtenu devrait nous permettre de mieux comprendre ses sœurs dans l'universunivers observable et, par voie de conséquence, la cosmologiecosmologie elle-même et l'évolution de la complexité du Big Bang au Vivant.

Gaia sera placé sur une orbiteorbite autour du SoleilSoleil bien spécifique, à savoir autour du deuxième point de Lagrange L2point de Lagrange L2, du nom du découvreur de ces points particuliers, le grand mathématicienmathématicien Joseph Louis Lagrange (1736-1813). Le satellite ira y rejoindre d'autres grands frères européens, Planck et Herschel, pour une mission de cinq ans. Il s'agit essentiellement de combiner des mesures d'astrométrie, de photométrie et de spectroscopie concernant pas loin d'un milliard d'étoiles, mais la chasse aux exoplanètes et aux géocroiseurs fait aussi partie du programme. Les premières estimations suggèrent que Gaia va détecter entre 10.000 et 50.000 planètes hors de notre Système solaire.

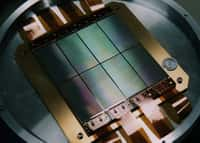

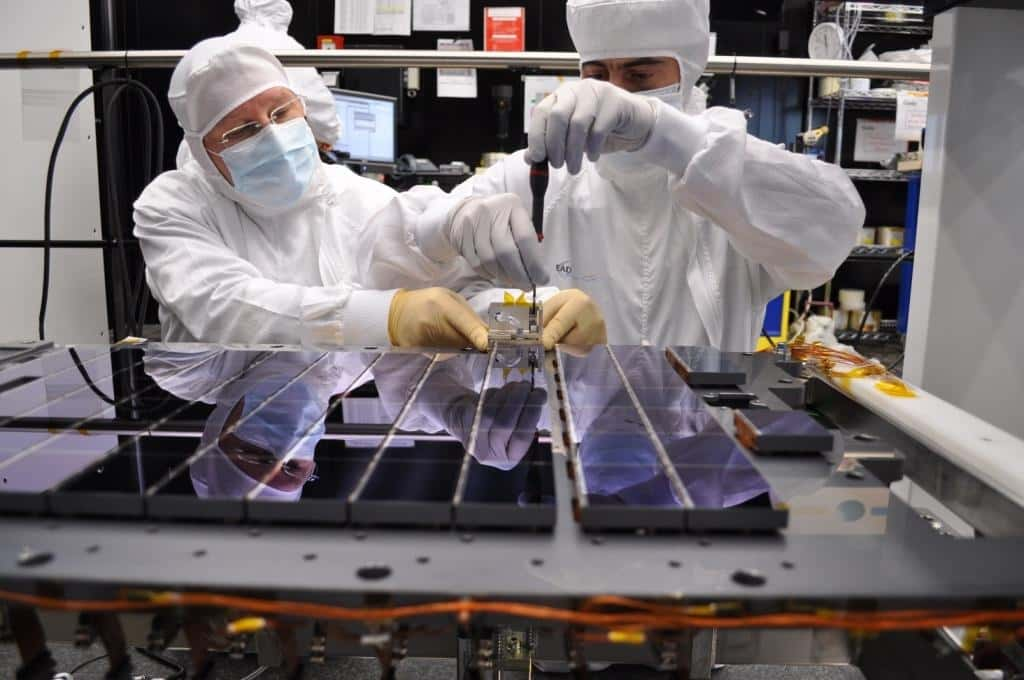

Pour cela, il disposera d'une caméra formée de 106 éléments CCD. Les fameux capteurscapteurs de Willard Boyle n'en ont donc pas encore fini de révolutionner le monde de l'astronomie et de l'astrophysiqueastrophysique. Or justement, l'Esa vient d'annoncer que ces 106 capteurs au milliard de pixelspixels ont été assemblés, formant l'une des pièces principales des instruments équipant Gaia.

Des techniciens en train de monter les capteurs CCD de Gaia dans une chambre blanche à Toulouse. Il y en a 106 au total et il fallait en moyenne une journée pour en installer 4. Les éléments sont sur des supports en carbure de silicium et l'ensemble pèse 20 kg. Chaque capteur CCD mesure 6 × 4,7 cm, avec une épaisseur de seulement quelques dizaines de microns. L'écart entre les CCD adjacentes est d'environ 1 mm. © Astrium

Gaia devrait faire au moins deux cents fois mieux qu'Hipparcos, son prédécesseur, dans le domaine de l'astrométrie, c'est-à-dire essentiellement la détermination des positions angulaires et mouvementsmouvements des astresastres. Ainsi, si Hipparcos pouvait mesurer depuis la Terre, l'angle qui correspond à la hauteur d'un astronauteastronaute debout sur la LuneLune, Gaia sera capable de mesurer celle de son pouce ! Le satellite devrait pouvoir mesurer les caractéristiques de jusqu'à 3 millions d'étoiles par degré carré et permettre de dresser en 3D une carte de tous les astres jusqu'à la magnitude 20 avec une précision à 20 μas (microseconde d'arc).

30.000 CD d'informations en cinq ans

S'y ajouteront des mesures spectroscopiques de haute résolutionrésolution et de photométrie qui permettront de placer avec précision les étoiles sur le diagramme de Hertzsprung-Russel. Il sera alors possible de faire d'impressionnantes statistiques sur les relations entre masses, compositions chimiques, luminositéluminosité, températures et distances des étoiles dans la Voie lactée. En plus de permettre de préciser la théorie de l'évolutionthéorie de l'évolution et de la structure stellaire, la connaissance accrue des positions, vitesses et compositions chimiques des populations d'étoiles ouvre la porteporte à leur utilisation comme de véritables traceurs de l'évolution chimique de la Galaxie et plus généralement de son histoire. En plus de donner des indications sur les processus de formation d’étoiles, des courants stellaires provenant d'anciennes galaxies nainesgalaxies naines absorbées ou en cours d'absorptionabsorption pourront ainsi être mis en évidence.

Si l'on considère que les étoiles sont l'équivalent des atomesatomes formant la Terre, astronomes et astrophysiciensastrophysiciens s'adonneront au même jeu que les géophysiciens et les géochimistes analysant la structure et l'évolution de notre planète, lorsqu'ils disposeront du flot de données que fournira Gaia. On estime que même compressées, ces données représenteront l'équivalent de 30.000 CDCD.

Ce qu’il faut

retenir

- Sans données spatiales correctement archivées, classées et sans accès rapide, les applications et services qui commercialisent ces données ne pourraient plus fonctionner correctement.

- L’archivage des données est la partie la moins visible des missions spatiales ; il conditionne la bonne utilisation et la bonne exploitation à la fin de la mission du satellite.

- Les solutions de stockage tiennent compte de nombreux paramètres, dont le coût de rétention au téraoctet, la sécurité et la rapidité de l’accessibilité.