La collaboration Extreme-Horizon, menée par des équipes du CEA, du CNRS, de Sorbonne Université et de l’Université Paris-Saclay, vient de rendre publics les résultats d'une simulation inédite de l’évolution des structures cosmiques formées des galaxies et trous noirs supermassifs. Ils vont nous aider à percer les secrets de la matière et de l'énergie noire.

au sommaire

Le prix Nobel de physique 2019 a notamment récompensé James Peebles, le grand cosmologiste d'origine canadienne à qui l'on doit des travaux de pionnier concernant le modèle standard en cosmologie. Il fut en effet l'un des premiers à être lucide sur la nécessité de réintroduire la constante cosmologique d'EinsteinEinstein produisant une accélération de l'expansion du cosmoscosmos observable, telle qu'elle a été découverte à la fin des années 1990. Cette constante peut s'expliquer par la présence d'une mystérieuse énergie noire dont la densité dominerait actuellement celle, moyenne, occupant un suffisamment grand volume d'espace pour que la distribution des galaxiesgalaxies soit homogène, à l'instar des moléculesmolécules d'un fluide que l'on peut considérer comme continu.

Nous ne connaissons pas la nature de cette constante cosmologique, même si bien des hypothèses crédibles ont été avancées à son sujet. Nous ne connaissons pas non plus la nature de la seconde composante de la densité de massemasse moyenne du volume d'espace précédent, la matière noirematière noire. Là aussi, les hypothèses ont été multipliées et nous n'avons toujours pas réussi à faire de détections directes ou indirectes des particules de matière noire, que ce soit avec le LHCLHC sur Terre, AMS dans l’espace ou encore Xenon 1T sous-terre.

Pire, il se pourrait que ni l'énergie noireénergie noire ni la matière noire n'existent. On arrive par exemple à remplacer la présence des particules de matière noire par une modification des équationséquations de la mécanique céleste newtonienne dans le cadre de la théorie MOND. Pourtant, les chercheurs continuent de favoriser le modèle de la matière noire froide, pourquoi ?

Jean-Pierre Luminet, directeur de recherche au CNRS et Françoise Combes, professeure au Collège de France, nous parlent des trous noirs. Ces astres compacts sont supermassifs au cœur des galaxies et ils coévoluent avec elles. Quand ce sont des quasars, on peut s'en servir efficacement pour faire de la cosmologie. © Fondation Hugot du Collège de France

Le vieux problème des biais d'observation en astronomie

Commençons par rappeler que même du temps des succès prodigieux de la mécanique céleste dans les mains de Lagrange, Gauss, Laplace et Le Verrier, les calculs sur les mouvementsmouvements des planètes, des comètescomètes et des astéroïdesastéroïdes, qui ont notamment mené à la découverte de NeptuneNeptune, ne reposaient sur aucune connaissance de la composition des astresastres. Il n'y avait pour autant aucune raison de douter de leur présence et du fait qu'ils possédaient une masse comme les objets connus sur Terre.

Dès ces époques héroïques, les astronomesastronomes savaient aussi qu'il fallait tenir compte d'effets influençant la propagation de la lumièrelumière dans un milieu entre ces astres et leurs instruments. La lumière est en effet réfractée par l'atmosphèreatmosphère de la Terre et ce d'autant plus qu'on observe un objet proche de l'horizon, ce qui affecte donc les mesures d'angles et de positions sur la voûte céleste, mesures à la base de toute l'astronomie.

Les astronomes modernes sont allés beaucoup plus loin. Ils savent qu'il faut tenir compte de plusieurs perturbations dont il faut corriger les effets, qui se produisent lors du voyage de la lumière entre leurs sources et nous. Il y a, par exemple, des effets d'absorptionabsorption par la poussière stellaire pour la lumière et les effets des champs magnétiqueschamps magnétiques chaotiques sur les trajectoires des particules de matière chargées, rendant difficile l'identification d'une source.

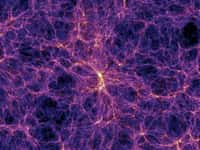

Pour développer et tester le modèle standard, les cosmologistes ont donc entrepris de faire des simulations numériquessimulations numériques puissantes des conséquences des modèles de matière et d'énergie noire, sur la naissance et l'évolution des galaxies et des grandes structures qui les rassemblent depuis la fin du Big Bang jusqu'à nos jours. Selon les hypothèses sur la matière noire et l'énergie noire, cette évolution n'est pas la même. Et en fouillant les stratesstrates de lumière de la mémoire du cosmos observable, en remontant de plus en plus loin dans le passé et en mesurant l'état des galaxies, il est donc en théorie possible de départager ces hypothèses en confrontant observations et prédictions théoriques.

Des théories cosmologiques testables en combinant simulations et observations

De nombreuses simulations numériques à ce sujet ont ainsi vu le jour au cours des dernières décennies. Futura vous avait déjà parlé de l'une d'entre elles dans le précédent article ci-dessous il y a huit ans, celle effectuée par le consortium DEUS (Dark Energy Universe Simulation)) dont le cœur est une équipe de chercheurs du Laboratoire UniversUnivers et Théories (LUTH, Observatoire de Paris/CNRS/Université Paris Diderot). Une autre, réalisée par la collaboration Extreme-Horizon menée par des équipes du CEA, du CNRS, de Sorbonne Université et de l'Université Paris-Saclay, vient d'occuper récemment le devant de la scène comme le prouvent deux publications dans MNRAS et A&A Letters que l'on peut trouver sur arXivarXiv.

Comme il y a huit ans, elle a été rendue possible par le supercalculateursupercalculateur Joliot-Curie, basé sur l'architecture BullSequana et conçu par la société Atos pour le Genci (Grand équipement national de calcul intensif). Elle a nécessité l'équivalent de cinquante millions d'heures de calcul et selon le communiqué du CEA à son sujet, il s'agit d'« une simulation inédite de l'évolution des structures cosmiques - galaxies, étoilesétoiles et trous noirs supermassifstrous noirs supermassifs - qui débute quelques instants après le Big-BangBig-Bang et se poursuit jusqu'à aujourd'hui. Les régions intergalactiques qui représentent 90 % du volume de l'Univers y sont décrites avec une résolutionrésolution sans précédent ». Et le communiqué d'ajouter que : « Le volume de données numériques traitées a dépassé 3 To (pour mémoire 1 To = 1012 octetsoctets) à chaque pas du calcul, justifiant la mise en œuvre de nouvelles techniques d'écriture (code numérique à raffinement adaptatif de maille RAMSES) et de lecture des données de simulation ».

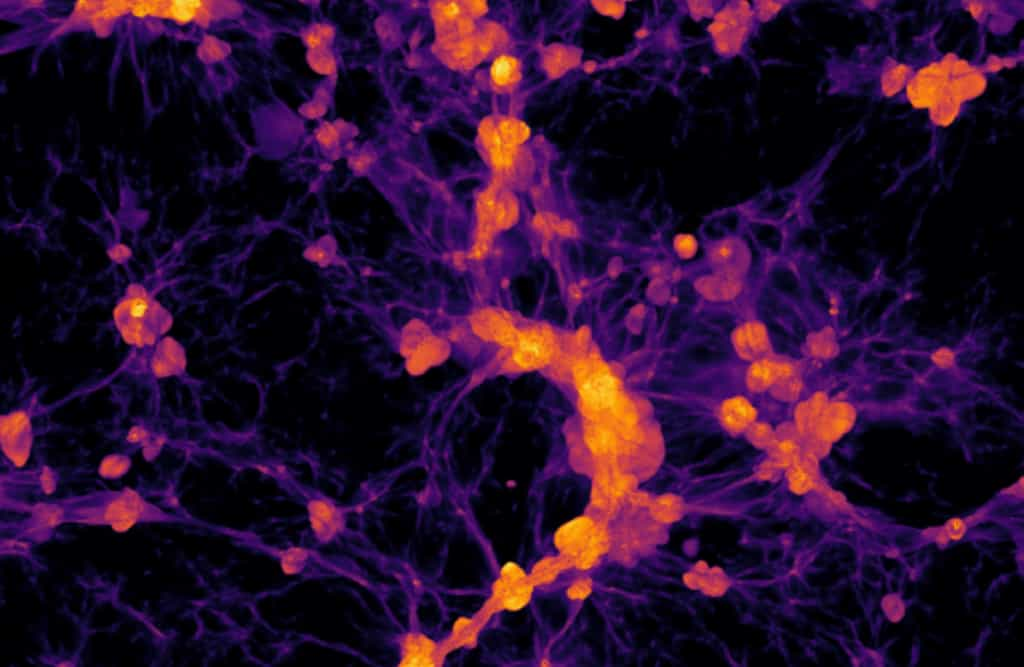

La collaboration Extreme-Horizon, menée par des équipes du CEA, du CNRS, de Sorbonne Université et de l’Université Paris-Saclay, a produit une simulation inédite de l’évolution des structures cosmiques – galaxies, étoiles et trous noirs supermassifs – qui débute quelques instants après le Big-Bang et se poursuit jusqu’à aujourd’hui. Les régions intergalactiques qui représentent 90 % du volume de l’Univers y sont décrites avec une résolution sans précédent. Cette simulation conduit à deux résultats surprenants aux échelles galactiques et cosmologiques qui constituent l’un des principaux « grands challenges » réalisés sur le supercalculateur Joliot-Curie de Genci, au sein du Très grand centre de calcul du CEA (TGCC). © CEA Sciences

Mais, comme on l'a expliqué, il faut tenir compte de certains biais observationnels pour effectuer des tests corrects d'hypothèses derrière des modèles. En l'occurrence, les membres de la collaboration Extreme-Horizon se sont penchés sur la question de savoir comment il fallait interpréter correctement les informations contenues dans ce que l'on appelle une forêt Lyman alpha. Comme l'a déjà expliqué ailleurs Futura, ce terme dérive de l'existence d'une série de raies associée aux niveaux d'énergie de l'atomeatome d'hydrogènehydrogène dite « Lyman alpha », car découverte au début du XXe siècle par le physicienphysicien américain Theodore Lyman. Elle est émise ou absorbée dans l'ultravioletultraviolet à 121,6 nanomètresnanomètres par des atomes d'hydrogène. Il est possible de détecter les grands nuagesnuages primordiaux d'hydrogène, grâce à leurs propriétés d'absorption de cette raie.

Ainsi, en observant une source très lointaine (décalage vers le rougedécalage vers le rouge de l'ordre de 2 ou plus) dont le spectrespectre est connu, on peut voir des raies d'absorption causées par ces nuages. La raie d'absorption de chaque nuage est décalée vers le rouge d'un facteur qui dépend de la distance à laquelle il se trouve. On observe alors dans le spectre des quasarsquasars tout un tas de raies correspondant à l'ensemble des nuages qui se trouvent sur la ligne de visée. On comprend donc pourquoi on parle de forêts Lyman alphaforêts Lyman alpha, chaque raie étant d'autant plus décalée vers le rouge que la matière responsable de cette absorption est lointaine.

L'analyse de ces forêts est d'une grande importance en cosmologie, d'une part parce qu'elles permettent d'étudier la manière dont les nuages sont répartis dans l'espace (et donc de tester les modèles de formation des grandes structures) et d'autre part parce qu'on peut mesurer la quantité de gazgaz présent dans les régions sondées.

Les forêts Lyman alpha et les trous noirs supermassifs

Seulement voilà, nous savons désormais que les trous noirs supermassifs sont présents dans quasiment toutes les grandes galaxies. Quand ils accrètent de grandes quantités de matière, par exemple sous forme de filaments de gaz froid, ils deviennent à l'origine des noyaux actifs de galaxiesnoyaux actifs de galaxies et en particulier des quasars avec des jets de matière. AstrophysiciensAstrophysiciens et cosmologistes ont mis en évidence le fait que ces trous noirs supermassifs injectaient donc de l'énergie dans la matière présente dans le milieu intergalactique, ce qui va donc contribuer à modifier l'effet de ce milieu sur la propagation de la lumière provenant des galaxies et des quasars et ainsi biaiser les interprétations des mesures portant sur les forêts Lyman alpha. Pour faire simple, les trous noirs supermassifs chauffent ce milieu de sorte que l'agitation des atomes y devient plus importante, causant des effets sur leurs raies, un phénomène que l'on connaît bien dans le cas des atmosphères stellaires et en particulier avec le SoleilSoleil.

Heureusement, les simulations de la collaboration Extreme-Horizon permettent maintenant d'estimer avec plus de précision les effets de ce biais et donc d'en tenir compte pour tirer de l'étude des forêts Lyman alpha de meilleures estimations des paramètres cosmologiques, comme l'explique le communiqué du CEA : « Le modèle physiquemodèle physique utilisé dans la simulation Extreme-Horizon décrit finement ces rétroactionsrétroactions qui biaisent les estimations des paramètres cosmologiques de quelques pourcents. Le facteur correctif calculé sera crucial en particulier pour l'expérience Desi (Dark Energy Spectroscopic Instrument), en constructionconstruction en Arizona (États-Unis), car il peut dépasser 5 % alors que la précision visée est 1 % », ainsi que le montre la vidéo ci-dessus. On aimerait bien en effet mesurer avec plus de précision la valeur de la constante cosmologique pour vérifier qu'elle est bien constante dans le temps. Certaines théories de l’énergie noire impliquent en effet qu’elle doit varier dans le temps et, si cette variation est suffisamment importante, nous allons bientôt disposer des instruments nécessaires pour la mettre en évidence, par exemple avec la mission Euclid.

Il y a un résultat en bonus fourni par les simulations, comme l'explique la vidéo du CEA ci-dessus. Une meilleure résolution dans les grilles utilisées pour résoudre numériquement les équations décrivant la dynamique de la formation des galaxies, en prenant donc mieux en compte le milieu interstellaire et l'effet du nouveau paradigme de la cosmologie faisant intervenir des courants froids de matière (comme nous l'avait expliqué le cosmologiste Romain Teyssier), a fait apparaître l'existence de nombreuses galaxies très petites et compactes. On commençait justement à voir des galaxies massives ultra-compactes nées lorsque l'Univers n'avait que 2 à 3 milliards d'années dans les données collectées récemment grâce au radiotélescoperadiotélescope Alma (Atacama Large Millimeter/Submillimiter Array), au Chili. Or, des sortes d'« essaims d'abeilles » de ces petites galaxies apparaissent maintenant comme une des clés permettant de comprendre la formation des galaxies massives ultra-compactes.

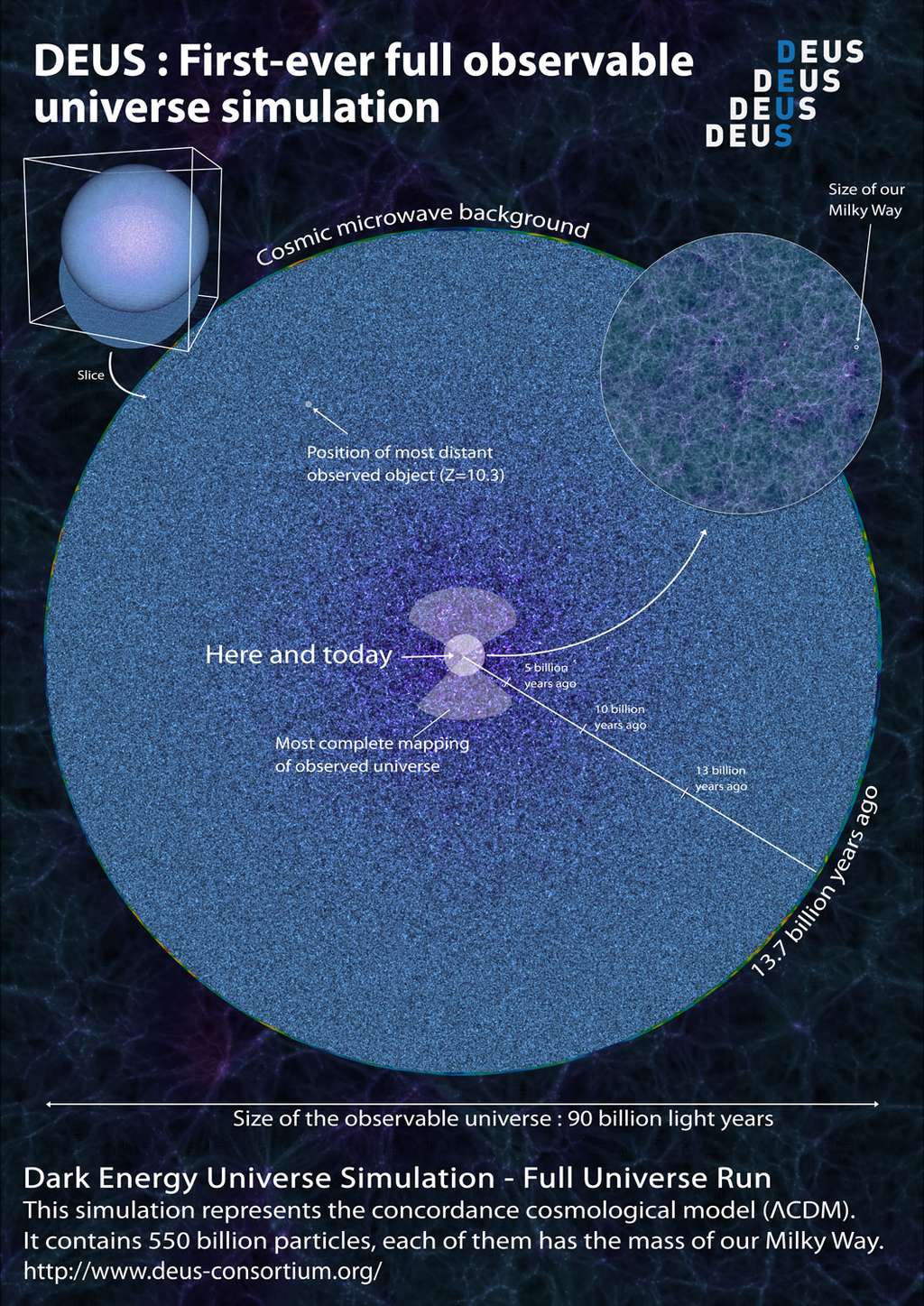

Rencontrez DEUS, la première simulation complète de l'univers observable

Article de Laurent SaccoLaurent Sacco publié le 16/04/2012

Un consortium baptisé DEUS effectue depuis plusieurs années des simulations de la formation des grandes structures de l'univers selon son contenu en matière et énergie noire. Le groupe de chercheurs français du Laboratoire Univers et Théories (LUTH), au cœur de ce projet, vient de réaliser la première simulation de tout le volume de l'univers observable, du Big Bang jusqu'à aujourd'hui, avec une constante cosmologique. Ce n'est qu'un début.

Un des verrousverrous à faire sauter pour comprendre l'évolution de l'univers, du Big Bang au Vivant, et tenter de prédire son destin, est incontestablement de faire la lumière sur la nature de l'énergie noire. Il n'y a guère de doute que l'expansion accélérée de l'universexpansion accélérée de l'univers observable découvert par Saul Perlmutter et ses collègues soit bien réelle. Mais l'on ignore si son explication repose sur la présence d'une vraie constante cosmologique, comme le pense Jean-Pierre Luminet, ou si elle est la manifestation d'une nouvelle physique nécessitant l'introduction de nouveaux champs (en général scalaires et dépendant du temps, voire de l'espace).

Une façon de le savoir est de déterminer l'influence exacte de l'énergie noire sur la formation des grandes structures dans l'univers, celles contenant des amas de galaxiesamas de galaxies. Comment se forment ces amas ? Comment se rassemblent-ils au cours du temps ?

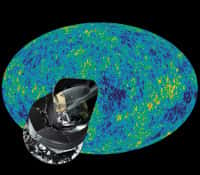

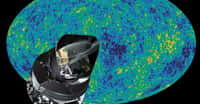

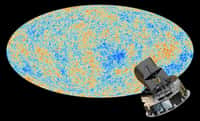

La matière noire a aussi son mot à dire et on peut espérer en apprendre plus en étudiant les données de PlanckPlanck sur le rayonnement fossile et les fameuses oscillations acoustiques de baryonsbaryons (BAO) ayant laissé leur traces dans la distribution des galaxies. Ces BAO sont étudiées avec le Baryon Oscillation Spectroscopic Survey (Boss) et le seront par le LSST et Euclid.

Un fabuleux voyage à travers l'univers observable, de la Terre jusqu'à la sphère de dernière diffusiondiffusion dont nous parviennent aujourd'hui les plus vieux photonsphotons de l'univers. Toutes les distances sont à l'échelle et les objets sont représentés avec le plus d'exactitude possible. Voir l'article sur le Tibet pour plus de détails. © Digital Universe, American Museum of Natural History/YoutubeYoutube. Musique : Suke Cerulo

Mais pour étudier la formation et l'évolution des grandes structures (déjà partiellement cartographiées comme le montre bien ce voyage des sommets du Tibet jusqu'aux frontières de l'univers observable), de l'amas local de galaxies jusqu'à celles situées à plus de 45 milliards d'années-lumièreannées-lumière et dont nous parviennent les plus vieux photons du cosmos, des observations ne suffisent pas. Il faut des prédictions théoriques numériques précises.

L'énergie noire sur supercalculateurs

Malheureusement, il arrive un moment où le régime de formation et d'évolution de ces grandes structures depuis les âges sombresâges sombres jusqu'à aujourd'hui ne peut plus être décrit que par des équations non-linéaires. L'utilisation de supercalculateurs devient un passage obligé et c'est pourquoi plusieurs groupes de par le monde ont développé des simulations de ces structures. On peut citer la fameuse Simulation du Millénaire ou celle de Joel Primack et ses collègues, la Bolshoi simulation.

Elles sont toutes dépassés en envergure par la dernière simulation effectuée par le consortium DEUS (Dark Energy Universe Simulation) dont le cœur est une équipe de chercheurs du Laboratoire Univers et Théories (LUTH, Observatoire de Paris/ CNRS/Université Paris Diderot) dirigée par Jean-Michel Alimi.

Les chercheurs avaient déjà réalisé des simulations de portions de l'univers observable avec différentes hypothèses sur l'énergie noire afin d'obtenir des prédictions comparables aux observations. Ils avaient ainsi simulé des univers, bien sûr emplis de matière noire froide mais avec une simple constante cosmologique () puis avec une théorie d'un champ scalaire et son potentiel proposée en 1988 par Ratra et Peebles (RPCDM). Une variante faisant intervenir la supergravité, proposée par Philippe Brax et Jérôme Martin, avait aussi été considérée.

Les cosmologistes vont donc maintenant plus loin.

Cette vidéo de présentation du projet DEUS montre deux simulations précédentes d'une portion de l'univers observable effectuées selon deux hypothèses différentes sur l'énergie noire. L'un est celle d'une vraie constante cosmologique (

De la Voie lactée à la surface de dernière diffusion

Grâce au nouveau supercalculateur Curie de GENCI exploité au Très Grand Centre de Calcul (TGGC) du CEA, les chercheurs viennent de réaliser pour la première fois le calcul de la structuration des galaxies dans tout le volume de l'univers observable, espace-tempsespace-temps compris c'est-à-dire du Big Bang jusqu'à aujourd'hui. Bien qu'il ne s'agisse pour le moment que d'un modèle cosmologique de type , ils entendent bien réaliser cette année de nouvelles simulations avec d'autres hypothèses sur l'énergie noire (RPCDM et avec énergie fantôme, celle donnant lieu au Big RipBig Rip).

Pour suivre le comportement des 550 milliards de particules modélisant les galaxies de l'Univers observable, il a donc fallu le supercalculateur Curie doté de plus de 92.000 unités de calcul et capable de réaliser 2 millions de milliards d'opérations à la seconde (soit 2 pétaflops). L'ensemble des simulations prévues, avec différents modèles cosmologiques pour l'énergie noire, devrait nécessiter de plus 30 millions d'heures de calcul, bien sûr effectuées en parallèle, faute de quoi il y faudrait près de 3.500 ans.

Les résultats obtenus permettront peut-être de mieux comprendre la nature de l'énergie noire et, à coup sûr, de mieux préparer des projets d'observation avec des instruments comme Euclid et le LSSTLSST.