Une équipe du MIT travaille sur une interface de contrôle des robots qui détecte actuellement huit gestes de navigation effectués à l’aide de la main et des muscles du bras. Ce système qui permet des manœuvres fines ouvre des perspectives prometteuses pour la cobotique.

au sommaire

Les travaux sur les interfaces homme-machine pour commander des robots ou des drones empruntent parfois des chemins surprenants. Après le drone piloté avec les yeux, plusieurs drones contrôlés simultanément par la pensée, voici le drone commandé par les muscles et les mouvementsmouvements du bras. Le projet est issu du fameux Computer Science & Artificial IntelligenceIntelligence Lab (CSAIL) du MIT qui explore notamment les solutions susceptibles de faire progresser la cobotique, c'est-à-dire la collaboration homme-robot.

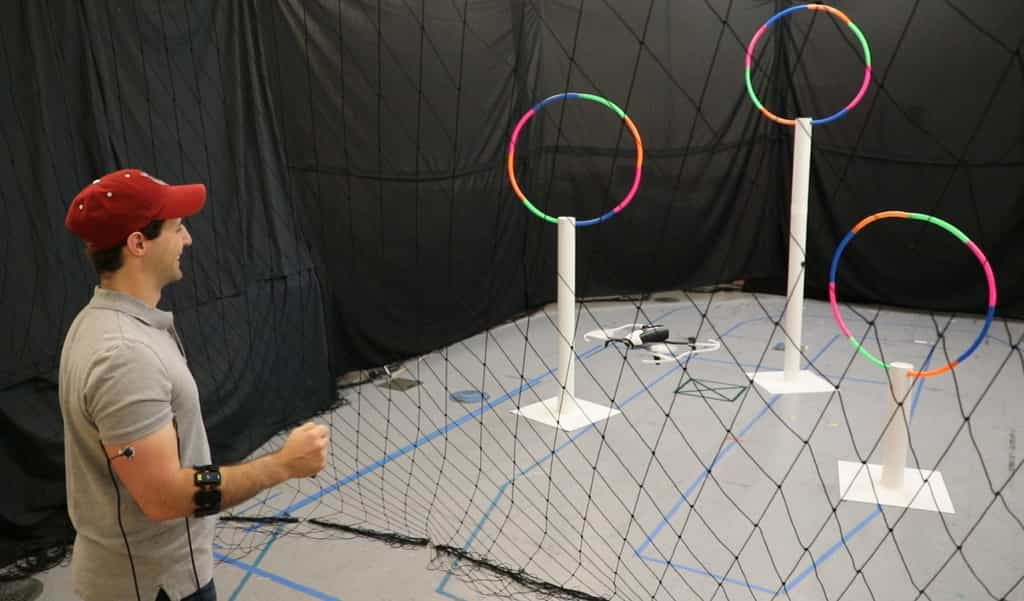

A l'aide d'un capteurcapteur de mouvement et d'électrodesélectrodes qui détectent les déplacements de la main et la contraction des triceps et biceps (électromyographie), le système actuel reconnaît huit gestes de navigation prédéfinis. Comme on peut le voir dans la vidéo ci-dessous, le contrôle permet des manœuvres précises et la latence entre la commande et son exécution est relativement courte.

L’interface de contrôle développée par le MIT combine détection de mouvement et électromyographie. © MIT CSAIL

Un système « plug and play » sans calibrage préalable

Selon les auteurs de cette expérience, le drone a reconnu 81,6% des gestes lors de ce parcours. Le système semble assez intuitif : mouvement du poignet vers la droite, la gauche, en haut et en bas pour les directions basiques, serrer le poing pour commander au drone d'avancer, contracter l'ensemble biceps et triceps pour lui ordonner de s'immobiliser. L'autre gros avantage est que le système ne nécessite pas de calibrage préalable.

Les chercheurs du CSAIL décrivent un système « plug and play » qui repose sur un algorithme d'apprentissage automatique qui traite les données en temps réel à travers un réseau neuronal entrainé grâce aux gestes des utilisateurs précédents. Le système peut se calibrer aux signaux de chaque personne, ce qui permet à n'importe qui de s'équiper des capteurs et de commencer directement à manœuvrer le drone.

« Permettre aux machines d'interpréter des commandes non verbales telles que des gestes peut contribuer à rendre les interactions plus similaires à celles avec une autre personne », estiment les auteurs de l'étude dans leur article publié par Association for Computing Machinery.