au sommaire

Au milieu du XXe siècle, les travaux de McCulloch et Pitts sur les neuronesneurones artificiels simulant les lois de la logique (1943) et ceux de Turing, concernant une machine universelle capable théoriquement de résoudre tous les problèmes en manipulant des symboles (1936, 1950), ont amorcé l'idée qu'il était possible qu'un système artificiel puisse être aussi performant qu'un esprit humain. Plongez au cœur de l'histoire de l'intelligence artificielleintelligence artificielle.

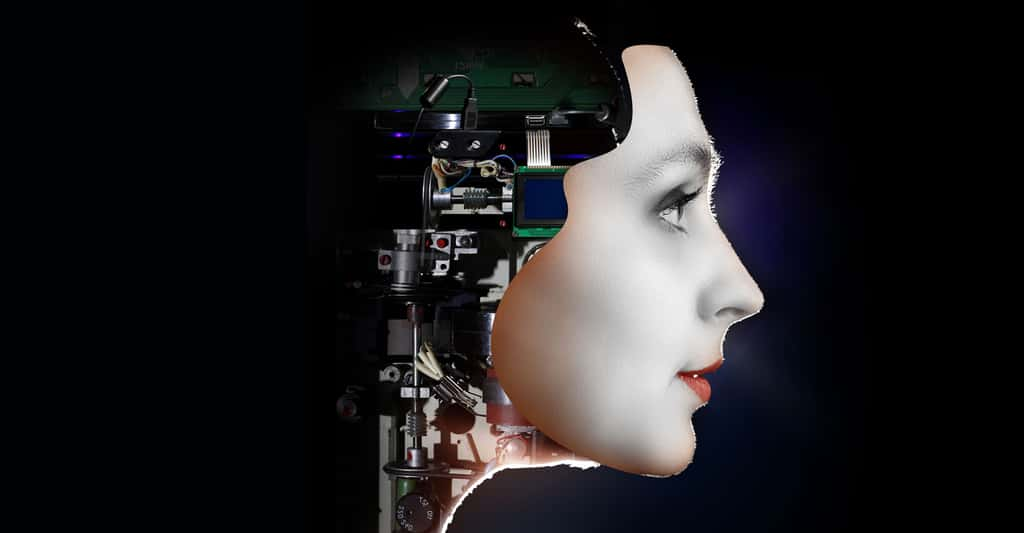

Quelle est l'histoire de l'intelligence artificielle ? Les robots auront-ils une conscience ? © Agsandrew, Shutterstock

L'apparition de l'intelligence artificielle

En 1956, l'avènement de l'intelligence artificielle (nom donné par McCarthy) a suscité la conception de systèmes ayant pour objectif délibéré de modéliser la complexité de l'intelligence humaine. Les chercheurs ont conçu ces systèmes comme des cerveaux isolés d'un corps, excluant l'action dans l'élaboration de leurs connaissances. Des réalisations semblaient prouver, par leur efficacité, que des ordinateursordinateurs pouvaient se passer d'organes sensoriels et moteurs pour raisonner ou communiquer.

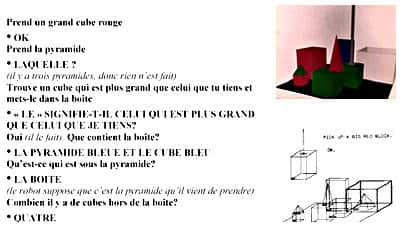

Par exemple, l'architecture de raisonnement à base de règles General Problem Solver (de Newell et Simon en 1963) était capable de résoudre des problèmes complexes. Un système expert comme Mycin (de Buchanan et Shortliffe en 1984) faisait des diagnosticsdiagnostics plus rapidement et précisément qu'un médecin spécialisé. Le robotrobot virtuel SHRDLU de Winograd (1971) pouvait dialoguer avec l'expérimentateur pour demander des éclaircissements sur l'objet qu'il devait choisir dans un monde de blocs virtuels.

Le robot virtuel « SHRDLU » dialogue (en majuscules) avec l'expérimentateur (en minuscules). © DR

En 1972, la critique du philosophe Dreyfus intitulée « What computers can't do » souligna néanmoins les limitations de ces systèmes, découlant principalement du fait que le programmeur doit avoir une connaissance a priori des conditions dans lesquelles les architectures cognitives sont testées. Un humain doit en effet fournir et préparer les données que le système artificiel aura en entrée -- notamment sous forme de symboles -- et il devra aussi interpréter les symboles que le système lui restituera en sortie. Ce faisant, l'Homme néglige d'apporter à la machine des connaissances qu'il ne juge pas utiles parce qu'elles lui paraissent évidentes, mais qui se révèlent absolument cruciales dans la résolutionrésolution de problèmes « de tous les jours » et dans la communication.

Petite histoire de l'intelligence artificielle. © automatesintelligents.com

Cyc : intelligence artificielle et sens commun

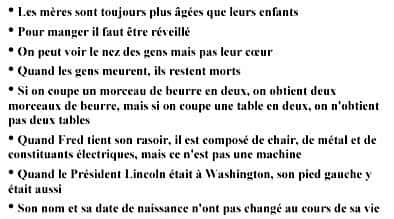

Ces connaissances implicites, partagées par tous les locuteurs, font partie de ce qu'on appelle le « sens commun ». C'est ce type d'informations que Lenat et Guha (de 1984 à 1990) ont tenté d'inculquer à Cyc, le dernier projet d'architecture cognitive de l'intelligence artificielle dite « classique », afin qu'il puisse communiquer en langage naturel avec les humains. Cyc devait élaborer son « sens commun » en organisant des connaissances de tous ordres, données sous forme de propositions par de nombreuses personnes de tous âges, de toutes conditions et de toutes situations sociales.

Quelques connaissances de « sens commun » que l'ordinateur Cyc a élaborées à partir d'informations fournies par des humains. © DR

Le projet n'a pas abouti et l'hypothèse la plus fréquemment évoquée expliquant son échec concerne le fait que Cyc n'a pas pu expérimenter le monde par ses capteurscapteurs et ses effecteurs, comme le réalisent tous les systèmes biologiques, humains ou non.

C'est par expérience qu'un organisme se forge toutes les informations qui lui seront indispensables pour « comprendre » son environnement physique et social afin de s'y comporter au mieux. Cette constructionconstruction nécessaire rejoint l'ancienne notion d'Umwelt (« monde propre »)) de l'éthologiste von Uexküll (1909), désignant la représentation du monde que se bâtit empiriquement chaque animal avec ses propres organes sensoriels et moteurs. Par définition, cette représentation sera différente entre espècesespèces - car elles n'ont pas les mêmes équipements -- et entre individus d'une même espèce -- car ils ne vivent jamais très exactement les mêmes expériences.