au sommaire

Pouvant bien sûr être utilisés dans le cadre de la recherche théorique en mathématiques par exemple, les supercalculateurssupercalculateurs trouvent leur application dans des problèmes beaucoup plus "concrets" et "médiatiques" telle que notamment la météorologiemétéorologie à long, voire très long terme.

C'est ainsi par exemple dans la prévision des conséquences des gazs à effet de serregazs à effet de serre sur l'écosystèmeécosystème de notre planète qu'ils pourront prouver leur utilité au grand public. Ils ont ainsi été utilisés notamment pour préparer le protocole de Kyotoprotocole de Kyoto en 2000.

La Complexité de la Simulation

La dimension d'une telle recherche orchestrée par un supercalculateur est multidisciplinaire et réunit ainsi à la fois biologistes, informaticiens, physiciensphysiciens.. Tout ce travail exige la création d'un ensemble de modèles à coupler, ce qui necessite, si l'on suppose qu'une dizaine de personnes y travaille par sous-module, une dizaine d'années d'élaboration ! ce temps de "constructionconstruction" du modèle est ainsi bien superieur au temps d'évolution du materiel,et, au moment où le résultat tant attendu est enfin obtenu, il est certain qu'on aurait pu faire infiniment mieux avec le materiel du moment.. Ceci exige de la part des programmateurs un certain sens de l'anticipation, pour tenter de pouvoir adapter, qui sait, au moins une partie de leur programme aux nouvelles technologies ..

Le problème dans la modélisation du climatclimat réside dans la variation entropique de celui-ci. Un simple facteur légerement accentué peut ainsi être à l'origine de fluctuations gigantesques dans le climat à l'échelle planétaire. Citons en exemple le décrochagedécrochage brutalobservé versle début des années 1800 suite au début de l'émission des gazs à effet de serre.

C'est pour cette raison qu'on ne peut encore envisager d'étudier un système d'une telle importance et entropie sur une longue échelle. Aussi, les simulations les plus avancées rendent elle compte de l'évolution du climat sur une échelle d'une centaine d'années, voire quelques siècles au maximum.

La Simulation d'un écosystème planétaire

Techniquement, une telle simulation va se baser sur la simulation de 3 modèles principaux : l'atmosphèreatmosphère, les Océans et les végétaux.

Les chiffres et données que nous allons évoquer ici sont ceux utilisés par l'Idris (CNRS) lors de sa dernière simulation, mais les ordres de grandeurs restent bien entendu valables pour toute simulation réelle.

Le modèle atmosphérique

Pour simuler l'atmosphère complexe de la Terre, le supercalculateur doit en fait résoudre des équationséquations dynamiques du système atmosphérique. Très complexes, celles-ci nécessitent pour leur résolutionrésolution des approximations, la précision des réponses dépendant bien sûr de l'ampleur de ces approximations. Et c'est le problème qui se pose : plus on va choisir un pas d'espace et de temps petit,plus les solutions seront précises et le modèle fiable. Mais plus la résolution des équations correspondantes sera longue ! Aussi faut-il trouver un certain compromis fiabilité / temps de calcul.

Compte tenu du fait que l'atmosphère est très grande, et relativement "homogène" dans des espaces restreints, on choisit ainsi un pas d'espace plutôt "grand" (!)) de l'ordre de 400 km, pour la simulation réalisée à l'Idris. Attention ! Si celà peut paraître important à première vue, il ne faut pas oublier que le modèle est à l'échelle de la planète, sur toute la largeur de l'atmosphère !

Au contraire, l'atmosphère étant assez dynamique, le pas de temps se devra d'être relativement court pour rendre compte des mouvementsmouvements rapides de celle-ci : il sera de l'ordre de la demi-heure.

Le modèle océanique

Très lié au premier et au moins aussi important, le problème quand à son élaboration est inverse. l'Océan est composé d'une multitude de petis courants mais qui sont non négligeables pour toute simulation "sérieuse". Au contraire, l'évolution d'un tel système est plutôt lente, et ne nécessite pas un suivi vraiment permanent. C'est pourquoi on privilegiera le pas d'espace, qui se doit de descendre jusqu'à un ordre d'une centaine de kilomètres, au détriment du pas temporel, de l'ordre de un jour.

Les autres Modèles

En plus de ces 2 modèles cités ici, il faut ajouter bien entendu d'autres composantes. On va ainsi, pour améliorer la précision, coupler la modélisation de l'atmosphère avec celle du cycle de CarboneCarbone. On va également prendre en compte et utiliser les modèles végétaux et biochimiques. Il s'agit en fait d'étendre le système physiquephysique à une modélisation qui incluerait l'aspect chimique et biophysique.

Ces ajouts aux 2 modèles principaux sont en fait la clé de la simulation. La différence d'importance et de soin accordé à un simple facteur peut en effet aboutir à long terme à 2 simulations radicalement différentes, comme pourront nous le prouver l'étude des 2 dernières simulations réalisées recemment. Ainsi, après quelques études s'est on aperçu qu'ils fallait tenir vraiment compte de l'influence de l'ozoneozone, ou encore des aérosolsaérosols !

Les résultats de telles simulations

Avant d'entrer plus un détail dans les résultats "scientifiques" de telles simulation, une petite idée du temps. La simulation réalisée par l'Idris a necessité 7 à 8 mois de temps de calcul au moment où elle a été réalisée. Avec l'amélioration des performances, cette même simulation se réaliserait maintenant en 1 à 2 mois pour une simulation de 1000 ans.Ceci ne représente que le temps de calcul pur, le temps de développement ayant dans le cas présent été de 3 ans environ.

Tout d'abord, il faut savoir que 2 études ont été réalisées récemment : l'une par l'idris, service du cnrs en France, l'autre par l'IPSL en Grande-bretagne : celles-ci n'ont pas donné des résultats tout à fait identiques. L'étude de l'Idris fut réalisée sur l'intervalle de temps compris entre les années 1860 et 2100. Les résulats principaux recherchés étaient essentiellement le niveau de CO² simulé dans un premier temps, et l'évolution de la température. C'est à peu près le seul travail demandé aux supercalculateurs. Après, aux biologistes et météorologistes d'en tirer les conclusions !

La différence majeure entre les 2 simulations fut l'importance donnée au phénomène suivant : lorsque le climat change, ce qui est le cas au cours du laps de temps étudié, une partie du carbone utilisé par les plantes l'est différemment. Et celà crée des différences énormes dans les résultats.

Il est à noter que nous ne détaillons pas beaucoup ici "ce qu'il va vraiment se passer au cours des 100 premières années". Cependant, il faut savoir qu'un dossier sur ce sujet est en préparation, afin de vous offrir une approche plus complète : ne le manquez pas ! ;-)

Limites Actuelles et Enjeux Futurs

Lors de la comparaison qui a put êytre faite des résultats prévu par les simulations et de la réalité, on s'est aperçu qu'existaient certaines discordancesdiscordances très importantes. Ainsi, on a pu notamment remarquer que certains faits ne pouvaient apparaitre dans les modèles sans adjonction par exemple de l'influence des gazs à effet de serre, c'est à dire qu'il fallait absolument prendre en compte l'intervention anthropogénique.

De plus, outre ces problèmes de "réglage", quelque chose d'autre gêne dans la confrontation à la réalité. Cette confrontation ne peut en effet, compte tenu de la valeur aléatoire de l'étude et de l'évolution simulé (on aura jamais absolument tous les paramètres dans leur moindre détail, donc, une place au hasard est laissée ... ), une comparaison rigoureuse ne pourra jamais se faire que sur un ensemble statistique, c'est à dire en comparant plusieurs simulations. or, on est amené ici à un murmur, le mur de la représentation statistique, d'autant plus infranchissable pour l'instant que la théorie, elle, est suffisante : c'est la capacité de calcul qui manque...

L'importance de telles études et l'augmentation de capacité des supercalculateurs conduit encore et toujours à une surenchère dans les simulations. Pour tenter de les améliorer, on a ainsi en résumé plusieurs choses à étudier.

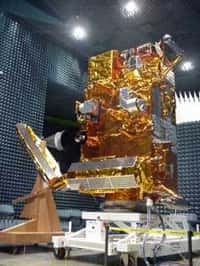

Le retour sur la dimension temporelle tout d'abord, couplée d'une tentative de zoom du modèle est à l'étude. On arrive ainsi par exemple à obtenir une résolution de quelques dizaines de kilomètres seulement sur l'Europe, ce qui permet de simuler au mieux les épisodes de pollution chimiquepollution chimique. Le but actuel est donc de généraliser cette pratique au monde et à de grandes échelles temporelles. A défaut de vaincre le mur statistique, on peut toujours s'attacher à abattre un par un les autres murs .. Et qui sait, un jour peut-être n'aurons nous même plus à utiliser de satellites pour connaitre le temps qu'il fait sur Terre .. Qui sait .. ;-)