au sommaire

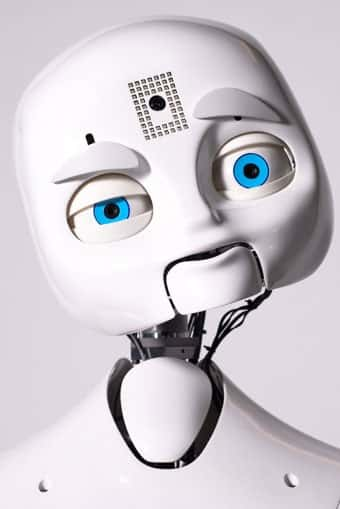

Nexi, le robot du Medialab, au MIT, analyse le comportement de l'humain qu'il a en face de lui et modifie en conséquence l'expression de son visage de plastique. © Medialab

Alors qu'ils en sont à leur onzième édition, l'équipe du Laval Virtual a vu les choses en grand. Image flagrante marquant une nouvelle ère pour le salon, le panneau portant le sigle du MIT (Massachusetts Institute of Technology)) qui n'est pas étranger au succès impressionnant des journées grand public faisant de l'année 2009 un excellent millésime.

Il existe dans le monde nombre de salons et d'exhibitions, bien souvent spécialisés et réservés aux journalistes et professionnels des secteurs concernés. Rares sont ceux qui permettent un contact direct avec un grand public toujours plus curieux. Le salon international de la réalité virtuelle a pour but de parvenir aux deux objectifs pour ainsi satisfaire professionnels et novices.

Cette année, le cap engagé depuis quelques années s'est fortement précisé et le terme réalité virtuelle s'efface au profit de la fameuse réalité augmentée qui réconcilie le réel et l'immatériel.

Quand nos yeux voient double

En guise de mise en bouche, certaines grandes marques présentaient leurs technologies. Sony montrait par exemple sa technologie de vidéoprojection 4K et NVidia exposait sa fameuse technologie stéréoscopique permettant ainsi aux sceptiques ou acheteurs potentiels de vérifier qu'ils ne faisaient pas partie des 9% de la population physiologiquement incapables de profiter de cette technologie. Au passage, signalons que ce chiffre semblait tout à fait crédible à l'exposant qui avait eu à quelques reprises des plaintes de mauvais fonctionnements ou de vision double.

Au-delà de la préoccupation promotionnelle, ces deux exposants avaient pleinement leur place et montraient, du moins pour le fondeur de GPU, qu'il serait aussi possible pour tout utilisateur de savourer dans un avenir imminent cette fameuse immersion promise depuis des années.

Dans cette optique, il faut saluer le travail des étudiants de l'université d'Auvergne qui nous ont présenté leur Catopsys project, un système d'immersion murale panoramique à bas coût composé simplement d'un vidéoprojecteur grand public type, d'un miroirmiroir sphérique, d'une caméra et d'un capteurcapteur permettant d'adapter l'espace virtuel ou le panoramique à la position de l'utilisateur. Dans un premier temps, la caméra analyse la pièce, décortique les surfaces, différences de profondeur, meubles, couleurscouleurs... Une fois ce calcul effectué, le logiciel modifie l'image projetée en jouant sur les contrastes, la colorimétrie et la luminositéluminosité pour contrebalancer les effets de réflexion de l'environnement. En sus, leur création compense également, en temps réel, les distorsions dues aux coins et aux différences de surfaces. Cette technologie prometteuse présente des similitudes avec d'autres, plus onéreuses, existant dans certains musées. Dans le château d'époque carolingienne de Mayenne, par exemple, les commentaires sont projetés sur les mursmurs eux-mêmes plutôt que sur des écrans, afin de ne pas endommager des pierres datant du onzième au treizième siècle.

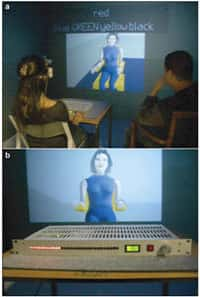

Asimov fait sa loi au Laval Virtual

Cette année, la robotiquerobotique tenait une place particulièrement remarquée avec la venue inespérée du MIT qui nous a présenté le projet phare du Medialab répondant au doux nom de Nexi. Cet androïdeandroïde aux formes volontairement caricaturales affiche une palette d'expressions impressionnantes, combinée à un flot de capteurs. Nexi repère les humains se trouvant en face de lui, en étudie le comportement et répond par une expression bien choisie. A terme, le but serait d'en faire une hôtesse d'accueil dans un environnement animé, comme un hôpital par exemple. Ce résultat, saisissant, est le fruit d'un travail gargantuesque autour d'une technologie de pointe tant sur le plan logiciel que matériel. A ces considérations informatiques et électroniques s'ajoutent des études sur les interactions homme-machine, la psychologie et autres sciences comportementales qui ont fait l'objet de maintes conférences durant le salon.

Nexi, noyé dans son public, subjugue les enfants, offrant une expérience rêvée aux deux membres de l’équipe, James Gray et Mikey Siegel.

Les Etats-Unis n'étaient pas les seuls représentants du monde cybernétique. Parmi les illustres invités on a pu compter des chercheurs du Ishikawa Komuro Laboratory ou bien de l'université de Tsukuba. Dans le domaine du spectaculaire, le projet Copy Cat Hand était un excellent ambassadeur. Son concepteur, Kiyoshi Hoshino, est spécialisé dans l'étude et la décomposition du mouvementmouvement humain. Parmi des travaux non exposés, on compte par exemple un projet de main apte à calligraphier, une des tâches demandant une forte dextérité, surtout dans le cas des kanji (idéogrammes japonais). Kiyoshi Hoshino a dirigé de nombreux projets, présentés sur son site InternetInternet dont une version dans la langue de Shakespeare est accessible. On trouve sur YouTubeYouTube des présentations par les chercheurs japonais, dans une ambiance décontractée, de leurs différents projets, notamment Wind Camera et La flèche de l’odeur, de Takayuki Kosaka, un jeu mêlant odeurs, mouvements et image.

La main présentée ici est exceptionnelle par le fait que le sujet ne porte aucun gant ni dispositif particulier. Un logiciel se charge d’analyser les mouvements filmés sur un fond uni, les retranscrit quasiment en temps réel sous forme de coordonnées utilisées pour mouvoir la main robotique. Ainsi dépourvus de contraintes, les étudiants démonstrateurs pouvaient facilement échanger leurs rôles.

A la croisée des techniques

Images immersives, odeurs synthétiques ou bien robotique, nous voici à la croisée des chemins et les concepts cumulant ces technologies abondent donnant tout son sens au terme de réalité augmentée. Plusieurs furent présentés dans cet esprit, tels La flèche de l'odeur, Scoop-and-Release, de l'université Tama, consistant à attraper un poissonpoisson virtuel dans une rivière projetée sur une surface réelle à l'aide d'un bol, réel lui aussi. Une fois attrapé, le poisson se retrouve projeté dans le bol... L'illusion est saisissante même si ce type de stand était avant tout destiné à émouvoir le jeune public.

Scoop-and-Release, un jeu entre réel et virtuel.

Un concept déjà bien connu était présent, LevelHead, du Néo-Zélandais Julian Oliver, un fervent défenseur de l'open sourceopen source ayant libéré le code de ce logiciel de réalité augmentée en juillet 2008. Le principe est simple : déplacer un personnage dans un cube virtuel en bougeant devant une caméra un petit cube réel.

Dans le domaine de la démesure s'exposait l'imposant projet R-Screen. Coréalisé par Renault et Clarté, il permet de faire le tour d'une voiturevoiture à l'échelle 1. L'énorme écran (en fait un vidéoprojecteur), de 2,50 mètres de profondeur, pour 1,80 mètre de hauteur, est motorisé et suit les mouvements de l'utilisateur

Toujours chez Clarté, WorkBench combine un écran horizontal et un écran vertical avec un contrôleur à retour de force, des lunettes stéréoscopiques et des capteurs. Il présente des scènes d'un réalismeréalisme saisissant sur lesquelles on peut agir pour simuler une action, par exemple faire un plein d'essence. Les applicationsapplications envisagées concernent la conception industrielle. Clarté n'en est pas à son premier larcin puisque l'entreprise est à l'initiative du fameux Sas-cube, encore aujourd'hui une référence en la matièrematière.

Au service des travailleurs, des handicapés et du monde médical

Notre vision et notre ouïe sont nos capacités sensorielles les plus souvent sollicitées par ces applications... voire malmenées. Mais on peut désormais ajouter le toucher et le mouvement corporel, avec des procédés connus dans le domaine du divertissement. Mais on est encore loin de satisfaire notre toucher ou notre odoratodorat, même si différentes tentatives plus ou moins fructueuses ont suscité quelques espoirs, comme le concept de France Telecom, Exhalia, en 2003.

La flèche de l'odeur de Takayuki Kosaka et sa Wind Camera poursuivent l'exploration de cette voie. De nombreuses tentatives ont eu lieu ces dernières années, majoritairement au Japon, avec la distribution de cartes chocolatées pour le film de Tim Burton Charlie et la Chocolaterie, un processus archaïque connu de longue date remplacé par les cinémas Shochiku et leur système permettant la restitution de six odeurs simultanément.

Certaines attractions onéreuses utilisent aussi des projections d'airair et autres moyens immersifs mais on est très loin de l'environnement du salon de monsieur tout le monde. A côté de ces réalisations volumineuses, les travaux de Takayuki Kosaka, eux, montrent que l'utilisation d'autres sens sera un jour du domaine du grand public.

Le retour de force peut aussi être considéré comme une avancée mais là encore il demande une installation lourde et coûteuse pour s'immerger dans de bonnes conditions dans le virtuel. Aussi d'autres moyens sont-ils utilisés. Par exemple, Good-bye feet!, de l'université de Tokyo, casse littéralement la réalité environnante pour donner la sensation d'être gigantesque. Issu de la même université, Thermotaxis permet au sujet de se mouvoir grâce à la température.

Les activités ludiques constituent une bonne vitrine pour ces applications mais cette débauche d'images et de servomoteurs peut aussi être utile. Le Haptic Radar, par exemple, à un travailleur d'anticiper des mouvements d'objets situés derrière lui. Il sera prévenu par des vibrationsvibrations sur son front, ce qui peut augmenter considérablement la sécurité sur un chantier. L'utilisation principale concernerait les aveugles, leur permettant de se mouvoir avec cette canne virtuelle bien plus précise et sécurisante.

Avec Haptic Radar, on a, en quelque sorte, des yeux derrière la tête.

La société locale Enozone présentait une borne interactiveborne interactive AcceS City, dévoilant aux Lavallois les projets d'aménagement des lieux publics pour les personnes à mobilité réduite. A l'usage, cet appareil s'est montré très convaincant et augure d'un nouveau genre de borne et d'interface grand public. A la manière d'un Google EarthGoogle Earth, on survole l'agglomération, on zoome et on sélectionne des informations, à l'aide de vignettes ou directement sur la carte rotative en 3D.

L'écran présenté était monopoint mais il est envisagé de passer à un modèle multipoint, plus commode. De plus, il n'est pour le moment pas envisagé de publier ce genre d'application sur Internet, les contraintes techniques étant trop importantes à l'heure actuelle.

Le Volume Slicing Display visualise des coupes d’objets 3D sur une simple surface plane en mouvement, comme une feuille de papier, que l'on tient dans la main.

Le domaine médical exploite depuis longtemps les progrès en matière d'imagerie et de réalité simulée ou augmentée. L'extraordinaire Volume Slicing Display témoigne qu'à l'évidence de grands progrès sont encore à venir.

VirTeasy, un simulateur de dentisteriedentisterie destiné à la formation, combinait robotique, capture du mouvement et immersion 3D. Ses contrôleurs à retour de force simulent la résistancerésistance des tissus. L'élève porteporte des capteurs de mouvements, qui le situent dans l'espace, et des lunettes-écran, qui lui restituent une image de la bouche du patient (voir la vidéo).