Elle se nomme GPT-3. Une intelligence artificielle est parvenue à écrire un article scientifique... sur elle-même ! L'auteur des instructions a ensuite tenté de le faire publier, non sans soulever des questions. Doit-on s'attendre à voir apparaître de plus en plus d'IA dans les auteurs d'études scientifiques ?

au sommaire

Pas le temps de lire ? Découvrez la version podcast (à écouter) de cette actualité dans Vitamine Tech, le nouveau podcast Futura 100 % dédié à la tech. © Futura

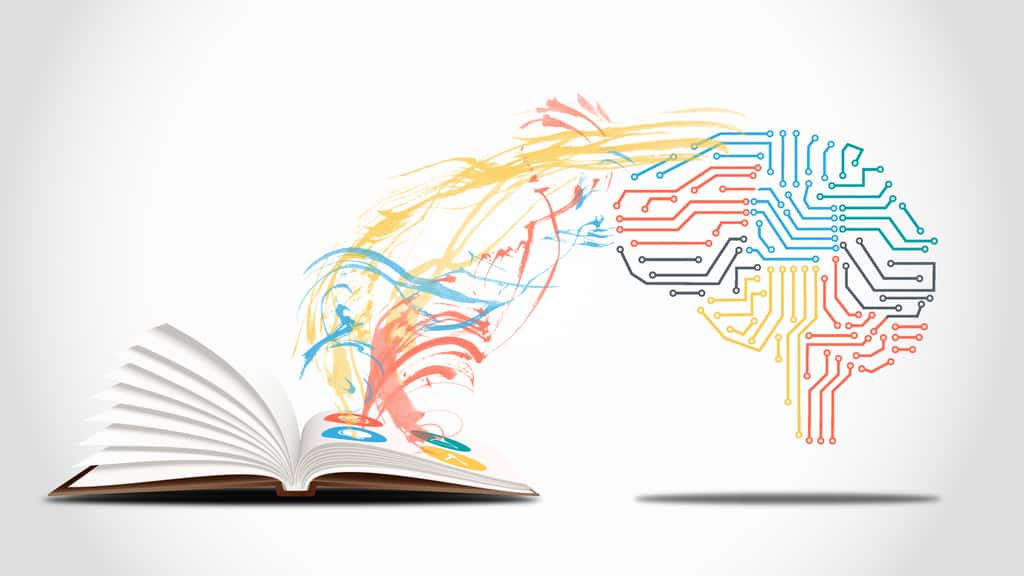

Pourra-t-on bientôt voir le nom d'intelligences artificielles en haut d'une publication scientifique, dans les auteurs ? Des chercheurs se posent de plus en plus la question. En particulier par rapport à une IA spécialisée dans le langage, appelée GPT-3, qui fonctionne par l'apprentissage automatique, ou machine learning. Développée par la société OpenAI qui a été fondée entre autres par Elon MuskElon Musk, elle appartient à la catégorie des « IA de génération », ou generative models, en anglais. Elle utilise une base de données en entrée pour créer de nouveaux points en sortie, cohérents avec cette base. Jusqu'ici, elle est parvenue à tenir des conversations écrites, faire des recommandations de films ou de livres, rédiger des articles de presse ou des mails de pishing, et même imiter des stylesstyles d'auteurs, plus précisément à écrire ce que l'on appelle des pastiches.

Écrire un article scientifique sur soi-même pour une IA, ça pose des questions !

Mais deux chercheurs de la société OpenIA, Almira Osmanovic Thunström et Steinn Steingrimsson, ont décidé de pousser le bouchon un peu plus loin, en lui demandant cette fois d'écrire un article universitaire scientifique court, de 500 mots. Jusque-là rien d'extraordinaire, car elle a été créée dans ce but, l'utilisation de données pour générer du contenu. Si ce n'est qu'ils lui ont cette fois-ci fait rédiger un article sur elle-même ! Comme ils le précisent dans une publication du Scientific American, « l'algorithme GPT-3 est relativement nouveau et, à ce titre, il existe moins d'études à ce sujet. » Le but était donc de faire écrire un article à cette IA sans qu'elle ne dispose d'une grande base de données, le tout en fournissant, comme pour tout bon article scientifique, des références et des citations. Et le résultat était là, « cela ressemblait, note A.O. Thunström, à toute autre introduction à une assez bonne publication scientifique. »

Intitulé « GPT-3 peut-il écrire un article académique sur lui-même, avec une contribution humaine minimale ? » et publié sur le service de prépublication HAL, l'article a été rédigé en seulement deux heures et remplit tous les critères d'un véritable article scientifique. On peut y lire dans l'abstract, rédigé donc par GPT-3, que « les avantages de laisser GPT-3 écrire sur lui-même l'emportent sur les risques. Cependant, nous recommandons que toute écriture de ce type soit étroitement surveillée par les chercheurs afin d'atténuer toute conséquence négative potentielle ».

« Nous espérons juste que nous n'avons pas ouvert une boîte de Pandore »

Mais quelles seraient les conséquences négatives potentielles citées dans l'abstract ? Les chercheurs s'inquiètent notamment de la conscience d'elle-même que GPT-3 pourrait développer : comme écrit dans la rubrique « discussion », donc rédigé directement par l'IA, « GPT-3 pourrait devenir conscient de lui-même et commencer à agir d'une manière qui n'est pas bénéfique pour les humains (par exemple, développer un désir de conquérir le monde) ». Un risque minime, mais présent néanmoins. Notamment car la conscience des IA a récemment fait l'objet d'un débat, avec celle de GoogleGoogle, laMDA, qui a été estimée consciente par l'un des anciens employés de l'entreprise. « Tout ce que nous savons, c'est que nous avons ouvert une porteporte, écrit A.O. Thunström. Nous espérons juste que nous n'avons pas ouvert une boîte de Pandore. »

Quant aux impacts positifs, qui selon les chercheurs dépassent les inquiétudes, ils sont aussi énumérés dans la partie « discussion » : « cela permettrait à GPT-3 de mieux se comprendre », et « cela pourrait l'aider à améliorer ses propres performances et capacités ». Mais aussi, et surtout, « cela donnerait un aperçu du fonctionnement et de la réflexion de GPT-3 ». Finalement, Almira Osmanovic Thunström questionne les implications qu'aura cet article sur la communauté scientifique. « Au-delà des détails de la paternité, écrit-elle, l'existence d'un tel article jette par la fenêtrefenêtre la notion de linéarité traditionnelle d'un article scientifique. »