Chez Google, on craint que ChatGPT ne vienne engendrer une révolution dans les moteurs de recherche qui pourrait mettre fin à l’ère du géant d’Internet.

au sommaire

C'est incontestable, le ChatGPT d'OpenAI est devenu en quelques semaines l'attraction numéro 1 de l'Intelligence artificielle, ouverte au grand public. ChatGPTChatGPT a réponse à presque tout sur la forme, même si c'est parfois de façon plus convaincante que sur le fond. Les puissants algorithmes de cette IA impressionnent et inquiètent.

Outre les interrogations éthiques, il y a celles qui tournent autour de l'économie. Et c'est de ce côté-là que lorgne du coin de l'œilœil la direction de GoogleGoogle. Interloquée par l'efficacité et la popularité de l'IA, selon les informations du New York Times, l'équipe de direction du géant de l'Internet aurait déclenché un « code rouge » pour son propre moteur de recherche. Le patron de Google, Sundar PichaiSundar Pichai, aurait ordonné à plusieurs équipes de renforcer leurs efforts sur la qualité des moteurs de recherche de l'entreprise pour les armer face à la potentielle menace posée par ChatGPT. Pourtant, avant l'acquisition et la transformation d'OpenAI en une société commerciale, chapeautée notamment par Elon MuskElon Musk, le développement de l'IA GPT, qui anime le chatbot, provient en partie des labos de Google.

Les algorithmes de ChatGPT ne fonctionnent pas comme ceux des moteurs de recherche habituels. ChatGPT cherche à comprendre les questions des utilisateurs et leur intention formulées en langage naturel. Le système de chat, c'est-à-dire de dialogue, permet à l'IA d'enrichir sa réflexion et de corriger le tir en cas de mauvaise interprétation. C'est cette révolution qui fait peur à Google si elle est implantée dès maintenant à des outils de recherche. Si la firme est devenue incontournable, c'est justement parce qu'en son temps, elle avait aussi mis en place une technologie qui a bouleversé Internet et éliminé la plupart des autres moteurs de recherche.

Google cherche à développer une IA sûre et compatible avec les pubs

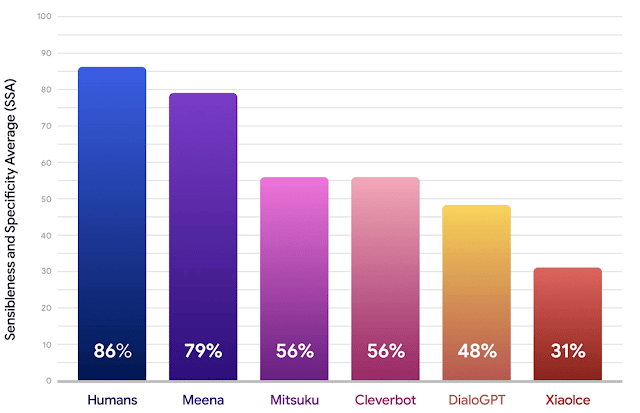

Pour le moment, cette IA n'a rien à voir avec un moteur de recherche comme celui de Google. Sa base de données est uniquement interne. Elle appuie ses réponses sur ce qu'elle a ingurgité jusqu'en 2021 et ne vient pas tirer d'informations provenant du Web. C'est pour cette raison que l'IA peut mentir ou faire de la désinformation en affirmant avec une rhétorique très convaincante de fausses informationsfausses informations. Mais, malgré cela, les bases sont là et cette sorte d'IA pourrait bien tirer la couverture à elle. Un comble pour Google qui dispose aussi de son propre chatbot, basé sur LaMDA, ou Language Model for Dialogue ApplicationsApplications. On peut le comparer à ChatGTP. Plutôt que d'ouvrir ses IA au public comme le fait OpenAI, Google préfère les intégrer dans de vrais produits avant de les proposer.

Si la firme souhaite aussi à terme que l'IA puisse servir à utiliser un moteur de recherche de façon sûre, elle bute également sur une incompatibilité rédhibitoire. Aujourd'hui, 80 % des revenus de Google proviennent de sa régie publicitaire. Or, l'IA d'un chatbot n'est pas du tout adaptée à la diffusiondiffusion de ces annonces. Les équipes vont donc devoir redoubler d'ingéniosité pour trouver une solution permettant d'écarter un trublion comme ChatGPS ou l'un de ses clonesclones.

Et puis, on se rappelle aussi les déconvenues de Meta, l'été dernier avec le BlenderBot 3, un chatbot capable de mener des discussions en allant glaner des informations sur Internet pour alimenter les débats. Moins de deux jours après son lancement, le chatbot a très rapidement commencé à tenir des propos conspirationnistes et antisémites. Finalement, à vouloir faire en sorte que l'IA réagisse comme un humain, les algorithmes se comportent un peu comme lui, en allant donner du crédit à des impressions massivement partagées.