Avec la menace d’attaques d’essaims de drones autonomes armés, les champs de bataille du futur seront hyperactifs et l’humain ne pourra compter que sur l’Intelligence artificielle pour se défendre. À condition de lui donner plus d’autonomie.

au sommaire

Des drones qui évoluent par essaim fondent de toutes parts sur des troupes au sol. Chargés d'explosifs, ils font un carnage en s'abattantabattant sur des soldats incapables de lutter contre autant de petits aéronefsaéronefs armés. Ce scénario envisageable est l'une des plus grandes craintes des militaires américains. S'ils arrivent en nombre suffisant, ces drones tueurs autonomes seraient trop rapides pour que les soldats puissent tenter quoi que ce soit, selon le général John Murray, chef de l'United States Army Futures Command, la branche militaire dédiée à la modernisation des armées américaines.

Lors d'un webinaire tenu dans le cadre du Center for Strategic & International Studies, le général a expliqué que, dans une telle situation, l'humain est à même de prendre les premières décisions mais que la nuée de drones ne lui permettra pas de résister longtemps. Pour lui, la seule façon de s'en sortir, c'est d'exploiter des systèmes de combat renforcés par de l'Intelligence artificielle (IA). Ils permettraient d'améliorer la reconnaissance et l'identification des cibles et surtout de gagner en réactivité.

“Avec l'hyperactivité des champs de bataille du futur, l’humain n'aura pas d'autre choix que de donner plus d'autonomie à la machine pour assurer sa propre défense”

Libérer l’IA pour survivre

Pour l'armée américaine, tout comme en France et la plupart des autres pays, il n'est pas question de conférer de l'autonomie à des systèmes de combats intelligents. C'est toujours l'humain qui doit contrôler et décider. Mais, dans le cadre d'un tel scénario, le général considère qu'il faudrait que le niveau de contrôle de l'humain sur l'IA soit franchement diminué. Cela signifie laisser plus d'autonomie à l'IA avec les risques éthiques ou de perte de contrôle que cela pourrait comporter.

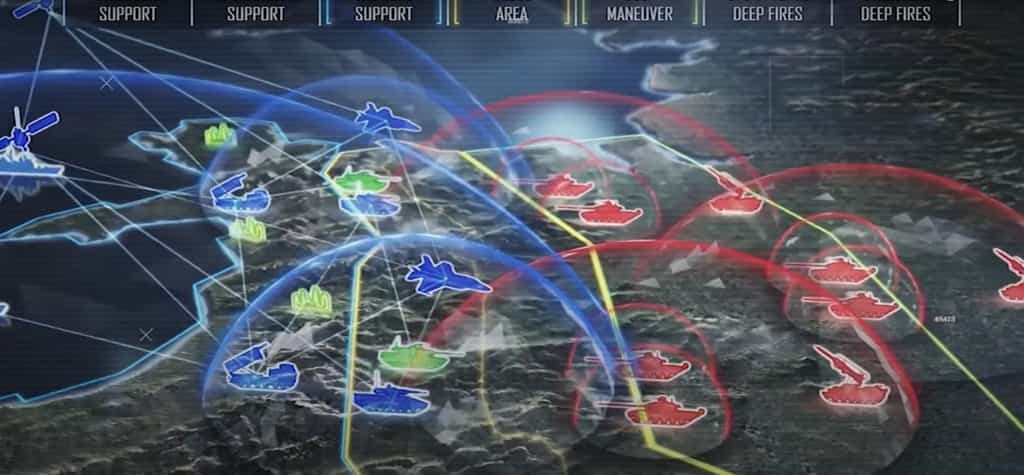

Le général Murray a tenté de rassurer, en expliquant qu'un exercice baptisé Project Convergence avait été mené en septembre en Arizona. Lors de celui-ci, des systèmes de combats dopés à l'IA combinés à des satellites en basse orbiteorbite, avaient réduit considérablement le temps nécessaire pour identifier, traquer et détruire les menaces aériennes. La précision apportée par ces IA débrayées oscillait entre 98 et 99 %. Un taux qui fait dire au haut gradé qu'avec l'hyperactivité des champs de bataille du futur, l'humain n'aura pas d'autre choix que de donner plus d'autonomie à la machine pour assurer sa propre défense.