au sommaire

Rendre tactile n'importe quel objet du quotidien afin d'y associer des applicationsapplications, tel est le but d'Anytouch. Une technologie mise au point par Ayotle, une start-up franco-mexicaine créée il y a deux ans et spécialisée dans les applications interactives basées sur la capture de mouvementsmouvements.

AnyTouch repose sur un logiciel qui interprète les informations d'un capteurcapteur de mouvements type Kinect et peut détecter les objets en volumevolume, les formes, les couleurscouleurs et les gestes. « La solution d'Ayotle est un middleware, c'est-à-dire que nous développons l'application entre le capteur et l'interface créée par le designer ou l'artiste. », a expliqué à Futura-Sciences Gisèle Belliot, P-DG et cofondatrice d'Ayotle. Pour illustrer le potentiel d'AnyTouch, une démonstration a été réalisée avec Digitas, une agence parisienne spécialisée dans le marketing interactifinteractif qui compte parmi ses clients Nissan. Digitas avait déjà créé pour le constructeur automobileautomobile un site Internet entièrement en FlashFlash 3D qui permet de personnaliser et de conduire une Nissan Juke. « Nous avons réutilisé le Nissan Stage 3D en créant un pont logiciel », explique Stéphane Maguet, en charge du projet chez Digitas Labs.

Une fois les objets « tactilisés » par AnyTouch, ils servent à commander des actions sur le module 3D de la voiture. © Ayotle/Digitals Labs/Viméo

Dans la vidéo de démonstration créée pour l'occasion, on découvre une image de l'application Nissan Stage 3D projetée sur une feuille de papier posée sur une table. Divers objets sont disposés sur cette feuille (une bouteille de soda, une figurine, une gomme, des jetons en plastiqueplastique). Un capteur de mouvements (en l'occurrence un modèle fabriqué par Asus) filme la scène et transmet les informations à AnyTouch. Tout se passe alors comme si ces objets étaient réellement tactiles. Ils fonctionnent comme les commandes d'un tableau de bord. En tournant par exemple la figurine à droite ou à gauche, l'utilisateur fait pivoter la Juke. Il choisit une nouvelle paire de jantes en substituant les jetons et zoome en passant son index le long de la bouteille de soda, sans la toucher.

AnyTouch peut non seulement réaliser une interface tactile sans toucher physiquephysique, mais il peut aussi reconnaître les gestes et les couleurs. Toujours dans la démonstration vidéo, on voit l'utilisateur modifier la teinte de la carrosserie en sélectionnant les couleurs sur un petit pantone dessiné directement sur la feuille. « Nous avons identifié les fonctions types présentes dans le module Nissan Stage 3D, que nous avons associées aux objets utilisés pour la démonstration », précise Stéphane Maguet.

AnyTouch : de très nombreuses applications

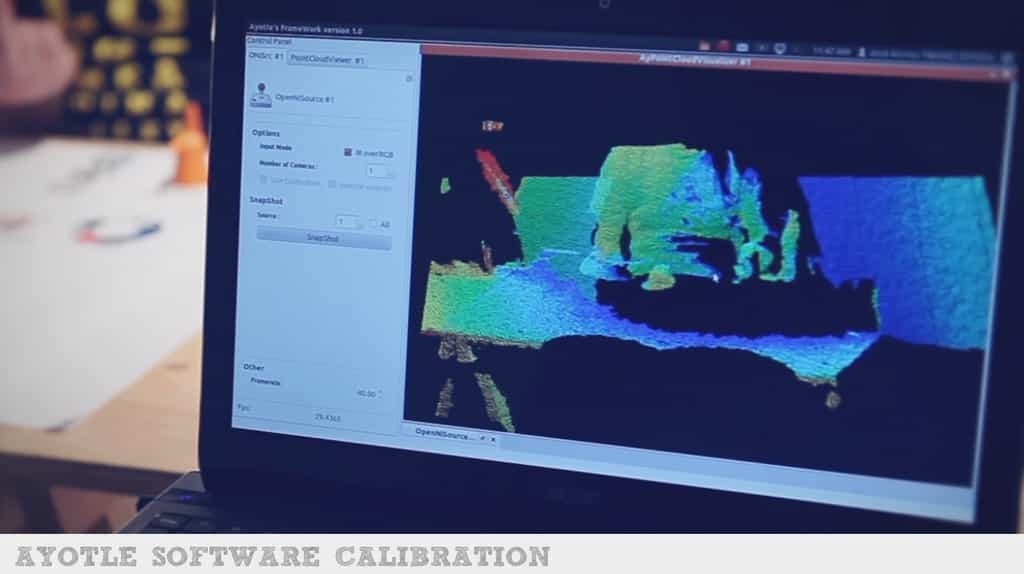

L'association entre les objets et une fonction ne se fait pas en temps réel, elle nécessite une phase de calibrage qui prend environ 2 heures, nous a-t-il expliqué. « On peut facilement changer d'objet pour s'adapter à une demande client. »

De son côté, Ayotle met en avant la souplesse de sa technologie qui est compatible avec tous les capteurs 3D existants (Kinect, Leap Motion...)) et peut fonctionner avec des interfaces créées à partir de Flash, HTML5 ou WebGL. « Autre avantage, nous nous épargnons la pose de multiples capteurs ou un dispositif lourd pour créer des objets interactifs. Ainsi les possibilités d'interaction se multiplient à un tarif très concurrentiel et une simplicité maximum. Le déploiement à grande échelle est également plus facile », souligne Gisèle Belliot.

On l'aura compris, AnyTouch peut donner naissance à un grand nombre d'applications interactives, notamment dans le domaine commercial. « On peut faire de la PLV [publicité sur le lieu de vente, NDLRNDLR] interactive, poursuit Stéphane Maguet, en plaçant un capteur au-dessus d'une palette de maquillage et en filmant le visage d'une personne, AnyTouch pourrait appliquer en temps réel sur l'écran les changements dès qu'elle touche une couleur. » Il nous a également laissé entendre qu'une démonstration pourrait avoir lieu avec Nissan lors d'un prochain salon automobile. L'idée est de « tactiliser » un véhicule de la marque en utilisant la technologie de mapping pour projeter des images en surimpression sur la carrosserie.

Ainsi, les visiteurs pourraient changer la couleur, faire apparaître le moteur avec des gestes, sans toucher la voiture. Un configurateur grandeur nature que l'on retrouvera peut-être un jour dans les halls d'exposition des concessions automobile ? « Pourquoi pas », admet Stéphane Maguet. On pense aussi évidemment aux jeux vidéojeux vidéo avec lesquels on pourrait interagir avec des objets usuels. « C'est quelque chose sur lequel nous travaillons, reconnaît le responsable de Digitas Labs, il faudrait pour cela que le joueur réalise une calibration de l'objet qu'il souhaite utiliser. » AnyTouch pourrait également permettre de créer des applications éducatives pertinentes dans les salles de classe ou encore dans les musées afin d'offrir une expérience interactive plus immersive.

« Le marché est très foisonnant et chaque jour nous découvrons des nouvelles applications » assure la patronne d'Ayotle. Elle explique par exemple qu'un industriel a demandé à utiliser AnyTouch pour que son personnel devant porter des gants de protection puisse interagir avec des écrans sans les toucher.