au sommaire

Le capteurcapteur de mouvementsmouvements Kinect de MicrosoftMicrosoft a ouvert la voie à une multitude d'innovations dans un grand nombre de domaines, qu'il s'agisse de contrôler un PC avec les yeuxyeux, de détecter un état dépressif, d'assister les chirurgiens lors d'interventions médicales ou encore de piloter des nanosatellites. L'accessoire est aussi beaucoup utilisé en robotique pour aider les appareils (robots, drones, etc.) à se repérer dans l'espace et identifier les objets.

Récemment, des chercheurs américains du Robot Learning Lab du département de science informatique de l'université Cornell ont exploité les capacités du capteur Kinect afin de travailler sur un système de robotique intuitive. Ils y ont associé un algorithme et une base de données qui permettent à un robot de reconnaître et d'anticiper une activité humaine, pour pouvoir apporter par exemple une assistance aux personnes.

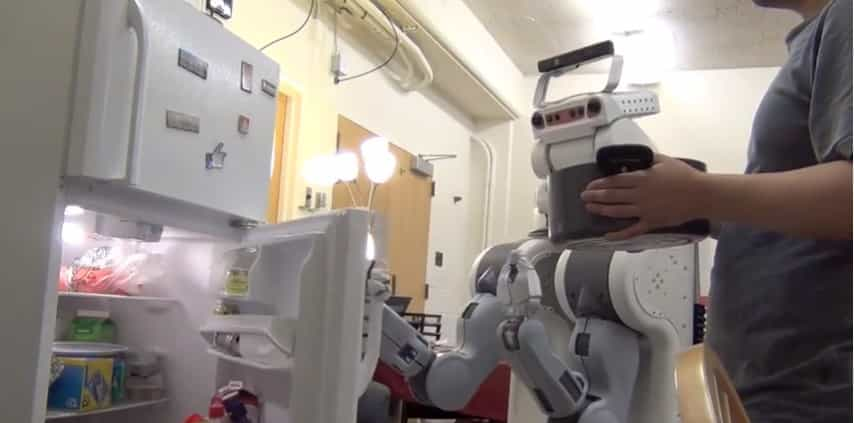

Pour pouvoir comprendre et anticiper une action humaine, le robot équipé du capteur Kinect extrapole différentes trajectoires possibles à partir de l’objet que l’utilisateur tient dans sa main. Dans le cas présent, il s’agit d’une tasse que la personne porte à ses lèvres. À partir du moment où elle amorce le geste pour la reposer sur la table, le robot élimine les autres possibilités et enclenche la séquence qui consistera à remplir la tasse. © Robot Learning Lab, Cornell University

En analysant les mouvements d'une personne, le robot pourra déduire ce qu'elle va faire en élaborant plusieurs scénarios possibles à partir de la pièce dans laquelle elle se trouve, de l'objet qu'elle saisit ou du geste qu'elle effectue. Par exemple, si le sujet se trouve dans la cuisine, à proximité du réfrigérateur et qu'il prend en main un plat, le robot sera capable de comprendre qu'il doit ouvrir la porteporte du réfrigérateur pour lui faciliter la tâche. Autre exemple, le robot observe une scène où quelqu'un se sert un bol de céréalescéréales. Le capteur Kinect détecte les mouvements du corps, identifie les objets posés sur la table (paquet de céréales, bol, bouteille de lait) et, une fois que la personne a fini de se servir, le robot déduit qu'il peut prendre la bouteille de lait pour la replacer dans le réfrigérateur.

Un robot-assistant qui anticipe les gestes humains grâce à Kinect

Afin de parvenir à ce résultat, les chercheurs expliquent dans leur article qu'ils ont créé une base de données à partir de gestes fréquents. Pour cela, ils ont placé quatre volontaires dans des environnements du quotidien, à savoir une cuisine, un bureau, une chambre, une salle de bain et un salon. Ils ont ensuite demandé à ces participants d'exécuter des activités comme se brosser les dents, mettre des lentilles de contactlentilles de contact, décrocher le téléphone, manger, boire, travailler devant un ordinateur. À chaque fois, ces scènes étaient filmées pendant 45 secondes par le capteur Kinect. L'équipe du Robot Learning Lab a ensuite associé ces données avec un algorithme spécialement développé. À chaque objet présent dans la scène et détecté par le Kinect est attribuée une action potentielle : par exemple pour une tasse seront associées les activités « boire » et « déplacement ».

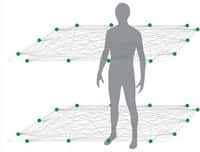

Pour que le robot puisse anticiper ce que la personne est susceptible de faire, il analyse la position de l'objet par rapport au corps. Si la tasse est proche de la bouche, il en conclut que l'action « boire » est en cours. Si au contraire la tasse est posée sur la table, cela peut correspondre à une action type « déplacement ». De là, le capteur modélise les trajectoires possibles, en créant des courbes de Bézier à partir de l'objet qui pointent vers les destinations potentielles. Il se sert de la base de données pour anticiper l'action la plus probable en fonction de tous les paramètres qu'il vient d'analyser.

Un projet robotique open source

L'un des avantages de cette innovation est qu'elle exploite finalement assez peu de données pour parvenir à ce résultat. Cette économie est très prometteuse quant aux possibilités de fiabiliser et de perfectionner ce système. La robotique intuitive pourrait ainsi trouver rapidement des débouchés dans l'assistance aux personnes âgées ou handicapées afin de les aider dans leurs tâches quotidienne, ou prévenir les risques d'accidents domestiques.

Qui plus est, l'équipe de l'université Cornell met son algorithme et la base de données gracieusement à disposition afin que quiconque puisse poursuivre le travail.