au sommaire

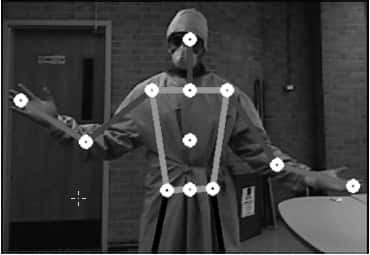

Le torse, la tête et les bras du praticien sont suivis en permanence par le capteur Kinect afin de recueillir des informations contextuelles qui alimentent l’algorithme. Selon les chercheurs, ces données ont permis de réduire de façon très significative le pourcentage de faux positifs. © Université Purdue

Lors d'une opération chirurgicale, les médecins utilisent couramment l'IRM (imagerie par résonance magnétiqueimagerie par résonance magnétique). La manipulation de ces images nécessite que le praticien (ou une personne qui l'assiste) accède à l'ordinateur pour afficher les clichés au cours de l'intervention. Ces manipulations peuvent parasiter la concentration et ajoutent un problème de stérilisation du matériel informatique, souris et clavier pouvant être des vecteurs de contaminationcontamination.

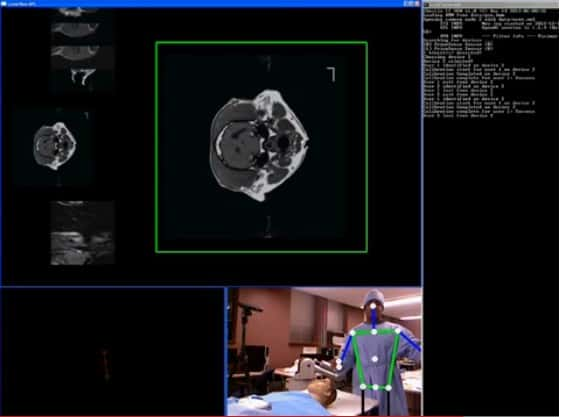

Une alternative qui est en train de s'imposer repose sur la technologie de détection des mouvements, afin de permettre aux chirurgiens de manipuler l'outil informatique et les contenus dont ils ont besoin par leurs seuls gestes. Le capteurcapteur Kinect de MicrosoftMicrosoft a ouvert de nombreuses possibilités dans ce domaine et donné lieu à diverses applicationsapplications. Récemment, des chercheurs de l'université Purdue aux États-Unis ont présenté un système de manipulation des IRM par les gestes qui a la particularité d'intégrer les informations contextuelles sur la position du torse, l'angle des bras, l'orientation de la tête et le regard de l'utilisateur pour déterminer quelle est son intention. « Les chirurgiens effectuent de nombreux gestes durant une intervention pour communiquer avec leurs confrères et les infirmiersinfirmiers. Le défi principal est de créer un algorithme capable de comprendre la différence entre ces gestes des commandes spécifiques pour consulter les images », explique Juan Pablo Wachs, l'un des chercheurs qui travaillent sur ce projet.

Dans cette simulation réalisée par les chercheurs de l’université Purdue, on peut voir comment un chirurgien manipule des IRM par les gestes de sa main gauche. On aperçoit le capteur Kinect dans le coin supérieur gauche de la fenêtre en bas au centre de l’écran. L’algorithme interprète la nature des gestes et déduit s’il s’agit ou non d’une commande pour manipuler une image. © Université Purdue

La main créée par le Kinect dirigée par les gestes

Pour définir les gestes les plus utiles pour manipuler les images, ils ont demandé à des chirurgiens vétérinairesvétérinaires de dresser une liste. Au final, dix gestes spécifiques ont été retenus : pivoter à droite et à gauche, zoomer et dézoomer, défiler vers la droite ou vers la gauche, vers le haut ou vers le bas, augmenter et réduire la luminosité.

L'algorithme va alors comparer les mouvementsmouvements du chirurgien avec cette base de données pour déterminer si le geste effectué appelle une manipulation d'image. Si tel est le cas, la trajectoire en 3D de la main créée par le capteur Kinect est décomposée en une série de symboles qui représentent la vitessevitesse de déplacement sur différents axes. La séquence est reconnue en utilisant un modèle de Markov caché (modèle statistique employé pour la reconnaissance de forme et en intelligence artificielle) qui est combiné avec la dernière commande gestuelle effectuée et le délai écoulé entre les commandes.

Le Kinect reconnaît 97 % des commandes

En tenant compte des informations contextuelles, la précision de l'algorithme augmente de façon significative. Dans leur rapport, les chercheurs de l'université Purdue indiquent que grâce à cette méthode, le pourcentage de faux positifs (le système confond un geste anodin avec une commande) est passé de 20,8 % à 2,3 %. La précision moyenne pour traduire un mouvement en commande est de 97 %.

Cependant, les scientifiques admettent que l'algorithme doit être amélioré dans le suivi de l'opérateur, car il arrive qu'il soit perturbé lorsque plusieurs personnes sont présentes dans le champ du capteur Kinect. Le développement du système va se poursuivre avec notamment la prise en compte de nouvelles informations contextuelles comme la position de l'instrument chirurgical dans le corps du patient afin d'anticiper le type d'IRM dont le chirurgien va avoir besoin. S'ensuivra un test à grande échelle sur un mannequin d'entraînement, comme ceux dont se servent les internes en chirurgiechirurgie pour répéter des interventions.