Des chercheurs de l’université de Stanford se sont inspirés de l’univers des Sims pour créer une petite ville dont les personnages sont animés par des intelligences artificielles génératives, chaque « agent génératif » ayant ses souvenirs, sa personnalité et menant des interactions sociales de façon autonome avec les autres individus.

au sommaire

Imaginez un monde dans lequel on ne ferait pas la différence entre des robots humanoïdesrobots humanoïdes et des humains. Un monde où ces robots auraient des interactions entre eux ressemblant de très près à celle des humains, avec des conversations permettant de se former des opinions, des souvenirs, des projets d'avenir, des sentiments amoureux.

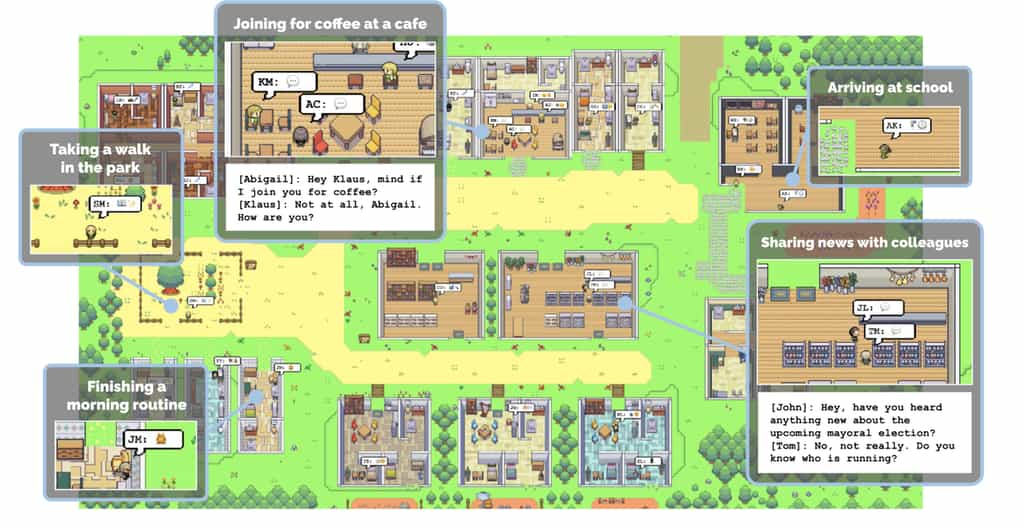

Ces comportements ont justement été simulés par des chercheurs de l'université de Stanford aux États-Unis. Ils ont créé 25 entités animées par des intelligences artificielles (IA) génératives qui ont communiqué entre elles. Chacune avait sa personnalité propre, ses compétences et des objectifs différents. Ces IA avaient également des souvenirs d'expériences passées qui ont construit leur personnalité et leur opinions. Ce monde virtuel peuplé de ces personnages est inspiré de celui des Sims, mais avec l'atout des IA génératives et des interactions en utilisant le langage naturel.

Pour concevoir l'IA de ces personnages, les chercheurs ont mixé des modèles de langage (LLM) comme GPT-3, ou Bert. Ils ont aussi créé les souvenirs des agents. Ces « agents génératifs » se livrent aux mêmes activités que nous, ils mangent, dorment, travaillent, se rencontrent, pratiquent des activités sportives, etc. Parmi les tests, les chercheurs ont pu observer les comportements sociaux dans ce petit bouillon social virtuel. L'un des faits les plus marquants de la simulation a été leur idée d'organiser une fête pour célébrer la Saint-Valentin. Dans les deux jours suivants, les « agents génératifs » ont diffusé d'eux-mêmes les invitations et se sont coordonnés et organisés pour mener à bien cette fête.

Observation, planification, réflexion

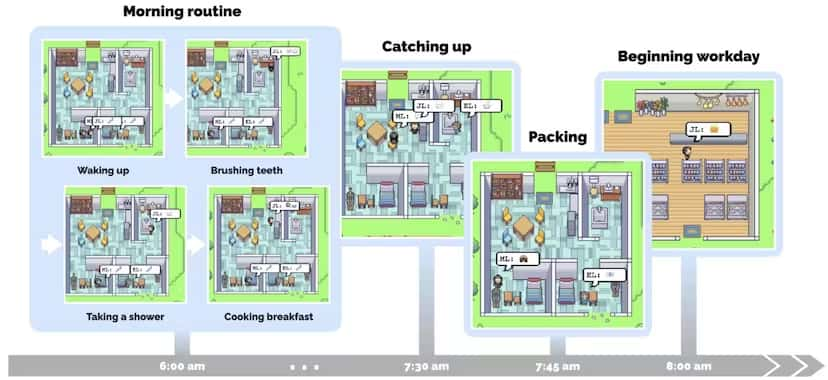

L'expérience de chaque agent reposait sur trois modules principaux : l'observation, la planification et la réflexion. Ainsi, l'IA qui observe, mémorise les données sensorielles (parole et vision) sous la forme de langage naturel. Ces données sont ensuite stockées pour faire évoluer l'agent. Pour ce qui est de la planification, elle repose justement sur ces souvenirs.

Ils permettent à l'agent de les utiliser pour générer le programme de ses prochaines actions. Cette planification est également mémorisée pour servir dans le futur. Enfin, le module de réflexion permet de synthétiser les souvenirs de l'agent au fil du temps sous la forme de langage naturel. Cela permet de résumer les expériences, les sentiments et de générer des opinions. Là encore, les réflexions sont stockées dans la mémoire tampon. Ces trois composants fonctionnent ensemble et c'est ce qui permet aux agents de générer des comportements réalistes et cohérents en accord avec leurs compétences, leurs goûts et leur personnalité. Avec ce procédé, tout ce petit monde initie des discussions et des interactions avec d'autres agents et des participants humains en langage naturel.

Plus crédibles que les humains sur certains points

Pour vérifier la crédibilité des agents virtuels, les chercheurs ont recruté 25 participants pour juger la qualité de ces agents génératifs et vérifier la cohérence de leurs comportements. Il ont aussi ajouté des agents qui étaient contrôlés par des humains. À la fin, les IA ont été mieux notées que les humains pour ce qui est de la cohérence de leur comportement. En revanche, sur les critères de personnalité et d'émotion, les participants ont considéré que les agents étaient moins doués. Sur ce point, les chercheurs ont constaté que ce manque de réalismeréalisme provient des limites du modèle qui ne repose que sur le langage naturel. Il lui manque tout ce qui est non verbal.

En améliorant ce type de simulation, les scientifiques souhaitent parvenir à approfondir l'étude des théories sociologiques. Mais cette simulation a également de quoi inquiéter. Elle rappelle fortement l'esprit de la série Westwold dans laquelle des robots humanoïdes simulent les activités sociales d'une petite ville dans un western. Dans ce parc d'attraction, les humains peuvent interagir avec les robots de façon réaliste et unique, et réaliser n'importe lequel de leurs désirs sur ces robots. Cela se transforme très rapidement en exactions avec une perte totale de morale de la part des humains. À la fin de la journée, les robots sont éteints et leur mémoire est effacée pour mieux recommencer le lendemain. La simulation de Smallville montre finalement que l'on n'est plus très loin de ce genre de fiction.