au sommaire

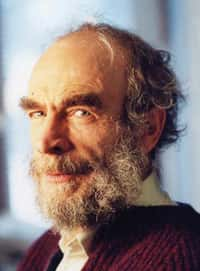

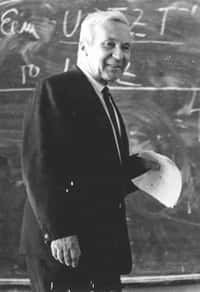

Le mathématicien Yakov Sinai a fait progresser l'étude des systèmes dynamiques, comme ceux décrivant les planètes ou le plasma dans un réacteur de fusion thermonucléaire. L'ensemble de ses travaux en physique mathématique lui a valu l'attribution du prix Abel 2014 de mathématique. © Université de Princeton, département de mathématiques

Pour 2014, le prix Abel, d'une valeur de six millions de couronnes norvégiennes, soit environ 730.000 euros, a été attribué au mathématicienmathématicien Yakov Sinai (né en 1935). Il est aujourd'hui professeur de physique mathématique à l'université de Princeton. Yakov Sinai est donc le collègue d'un autre lauréat du prix Abel, le mathématicien belge Pierre Deligne, mais c'est en Russie qu'il a commencé sa carrière avant d'émigrer aux États-Unis au début des années 1990, après la chute de l'URSS. Sinai est un nouvel exemple de l'excellence de l'école de mathématique russe, qui compte des noms prestigieux comme Gelfand, Gromov et Kontsevich. Il fut comme Vladimir Arnold l'élève d'Andrei Kolmogorov, auteur d'importants travaux sur la théorie des systèmes dynamiques, la turbulence, la mécanique céleste, la théorie de la complexité, l'analyse fonctionnelle et l'axiomatisation de la théorie des probabilités.

Sinai va continuer dans le sillage de son maître en étudiant en tant que mathématicien des problèmes mathématiques directement liés à la physique théorique. En d'autres termes, ses domaines de recherche relèvent plus de la physique mathématique que de la physique théorique. Il va commencer à se faire un nom en introduisant ce que l'on appelle l'entropie de Kolmogorov-Sinai, puis avec des travaux sur la théorie ergodique.

Ergodicité et systèmes dynamiques

La notion d'entropie a été précisée une première fois en physique par Boltzmann et Gibbs dans leurs travaux sur la mécanique statistique et la théorie cinétique des gaz. Elle s'introduit naturellement comme une mesure du désordre d'un système de particules formant un gaz. Les mouvements des particules de ce gaz sont décrits par les équationséquations de la mécanique analytique développée par Lagrange et Hamilton. Comme les positions et les vitessesvitesses des particules de ce gaz ne sont pas connues avec précision, il faut introduire des notions issues du calcul des probabilités pour estimer des moyennes dans le temps et dans l'espace de ces propriétés.

On en comprend sans peine la nécessité. Décrire l'état de mouvement d'une seule particule soumise à des forces suppose de connaître trois positions et trois vitesses initiales. Pour décrire une molemole de gaz contenant N particules (environ 6,02 x 1023), il faudrait en théorie connaître 6N quantités et résoudre un système de 6N équations différentielles non linéaires du premier ordre.

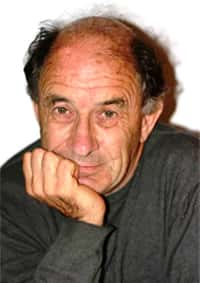

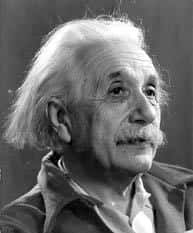

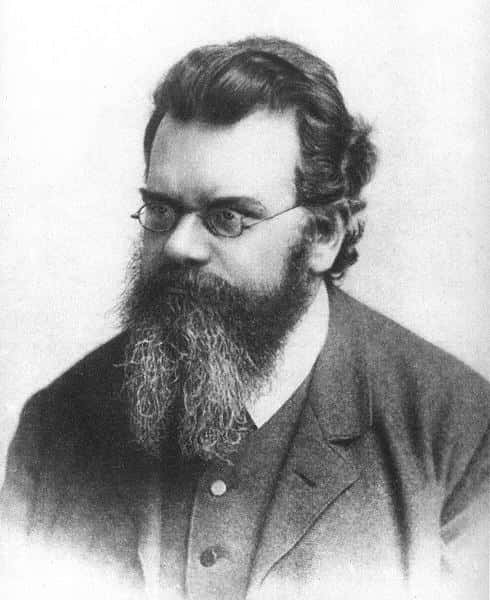

Ludwig Eduard Boltzmann (1844-1906) est un physicien autrichien considéré comme l’un des pères de la mécanique statistique. Défenseur de l’existence des atomes, hypothèse sur laquelle toute son œuvre était bâtie, il s’est suicidé en 1906 devant l’opposition quasi générale des chercheurs de l’époque, qui préféraient une image du monde basée sur le concept d’énergie et rejetaient le concept d’atome, sous prétexte qu’on ne pourrait jamais les observer. Les travaux de Boltzmann ont fortement influencé Einstein et Schrödinger et sont à l’origine de la révolution quantique via l’introduction du quantum d’action par Planck. Il est le premier à avoir donné une interprétation statistique de l'entropie et à avoir utilisé l'hypothèse ergodique pour fonder la mécanique statistique. © Wikipédia, DP

L'obstacle peut être partiellement contourné en considérant que l'état de ce gaz est défini par un point dans un espace à 6N dimensions, celui des positions et des vitesses des particules qui le constituent. Son évolution dans le temps décrit une courbe dans cet espace qui peut être très compliquée. On raisonne finalement sur des ensembles de points décrivant un très grand nombre d'exemplaires du même gaz, mais avec des coordonnées initiales différentes, et on introduit l'hypothèse que des moyennes dans le temps du comportement d'un exemplaire de ce gaz sont équivalentes à des moyennes concernant les différents exemplaires de gaz.

C'est l'hypothèse ergodique, comme l'ont appelée en 1911 les époux Ehrenfest dans leur célèbre article sur les fondements de la physique statistique. Elle revient en gros à dire que le point décrivant l'état du gaz dans l'espace que considéré précédemment va passer au cours du temps par presque tous les états qui lui sont accessibles (avec une énergieénergie totale constante pour le gaz). Au bout d'un temps suffisamment long, les probabilités de le trouver dans un état donné (on parle de microétats, par opposition à des macroétats, comme la pressionpression et la température macroscopique d'un gaz) sont les mêmes. Ainsi, le gaz finit par perdre la mémoire de ses conditions initiales.

Ergodicité et chaos

Si on laisse tomber une goutte d'encre dans un verre d'eau, les moléculesmolécules de l'encre ne vont pas rester confinées dans un coin du verre d'eau. Elles finiront par se répartir uniformément dans l'espace qui leur est accessible, agissant comme les particules d'un gaz confinées initialement dans une petite région d'un conteneur. L'état des molécules d'encre devient donc de plus en plus désordonné : il y a croissance d'une quantité que l'on appelle l'entropie. Une fois l'état d'équilibre atteint, on peut faire des prédictions sur les valeurs moyennes des propriétés des molécules d'encre en utilisant la théorie cinétique des gaz et en supposant que l'hypothèse ergodique est vérifiée par les équations décrivant ce système.

Bon nombre de systèmes physiques à grand nombre de degrés de liberté (comme une population d'atomesatomes avec des spinsspins, un ensemble de planètes ou d'étoilesétoiles dans une galaxiegalaxie) peuvent être ramenés à une description analogue à celle du gaz décrit ci-dessus. L'analyse des équations différentielles gouvernant ces systèmes constitue ce qu'on appelle la théorie des systèmes dynamiques, et la physique de ces systèmes à très grand nombre de degrés de liberté est du ressort de la mécanique statistique. D'un point de vue mathématique, il faut alors essayer de démontrer si les systèmes considérés satisfont ou non à l'hypothèse ergodique et préciser aussi la notion d'entropie.

Cette vidéo montre les résultats d'une simulation numérique concernant 500 particules qui n'interagissent pas entre elles, mais qui rebondissent élastiquement sur les parois d'un billard en forme de stade. Les segments rouges représentent des vecteurs vitesse. Initialement, toutes les particules ont la même vitesse, mais des positions légèrement différentes. La dynamique de ce billard, appelé stade de Bunimovich, est ergodique et chaotique. On voit que ce système dynamique devient rapidement désordonné et qu'il explore tous ses états accessibles. © Nils Berglund, YouTube

Les systèmes dynamiques ont des comportements parfois complexes et, comme Poincaré a été l'un des premiers à le comprendre avec son collègue français Jacques Hadamard, ils peuvent être très sensibles aux conditions initiales, ce qui conduit à un comportement chaotique. En théorie, les systèmes dynamiques chaotiques sont déterministes : c'est le cas de l'atmosphèreatmosphère sur Terre et des planètes du Système solaireSystème solaire.

En pratique, on peut parfois perdre rapidement tout pouvoir de prédiction sur ces systèmes, comme le montre l'exemple de la météorologiemétéorologie. L'entropie de Kolmogorov-Sinai (K-S) d'un système dynamique est une quantité que l'on peut lui associer pour obtenir une sorte de mesure de sa capacité à échapper à toute prédiction. Si le comportement du système peut être toujours prédit, son entropie K-S est nulle. L'entropie K-S est donc en quelque sorte une mesure de la capacité d'un système à avoir un comportement chaotique complexe et en apparence désordonné.

Les billards chaotiques

Comme l'entropie K-S d'un système est reliée à la possibilité pour ce système d'explorer tous les états qui lui sont accessibles, Sinai s'est aussi occupé de problème relevant de la théorie ergodique. Pour étudier le comportement des systèmes dynamiques et mieux comprendre à quelles conditions un système satisfait à l'hypothèse d'ergodicité, Sinai a considéré une variante du billard d'Hadamard. Le mathématicien français avait cherché à résoudre le problème de la stabilité des orbitesorbites du Système solaire en considérant le comportement d'une boule roulant sur la surface d'un billard courbé négativement, comme l'est la surface d'une selle de cheval. Sinai va modifier le problème en considérant une surface plane pour un billard carré, avec au centre un cercle sur lequel rebondissent deux boules. Le mathématicien va démontrer que le système dynamique correspondant est bien ergodique. C'est la première fois qu'une telle démonstration a pu être apportée pour un système dynamique. Le chercheur a aussi montré qu'il était chaotique.

À la suite de ces travaux, d'autres billards similaires vont être étudiés, comme le stade de Bunimovic, mais aussi ceux qui émergentémergent en relativité généralerelativité générale et même en cosmologie des supercordes lorsqu'on veut comprendre le comportement chaotique de l'espace-tempsespace-temps découvert par Belinsky, Khalatnikov et Lifshitz (BKL) avec les singularités produites par l'effondrementeffondrement gravitationnel.

Ce faisant, Yakov Sinai a ouvert des voies qui ont permis de mieux comprendre la turbulence dans les fluides (lui-même à travailler sur les équations de Navier-Stokes), le chaos en mécanique quantiquemécanique quantique ainsi que divers problèmes de mécanique statistique comme ceux relevant des transitions de phasetransitions de phase. C'est d'ailleurs lui qui a donné un traitement rigoureux des travaux du prix Nobel de physique Kenneth Wilson sur ce sujet avec le groupe de renormalisation.